Google reveló por primera vez que su equipo de seguridad descubrió y bloqueó con éxito un exploit de día cero que se sospecha fue desarrollado por inteligencia artificial durante un ciberataque en curso. Según un informe publicado por Google Threat Intelligence Group (GTIG), el ataque fue orquestado por un "conocido actor de amenazas cibercriminales" en un intento de lanzar un "evento de explotación a gran escala" y apuntar a una "herramienta de administración de sistemas de código abierto basada en web" anónima y utilizarla para evitar el mecanismo de autenticación de dos factores (2FA) de la plataforma.

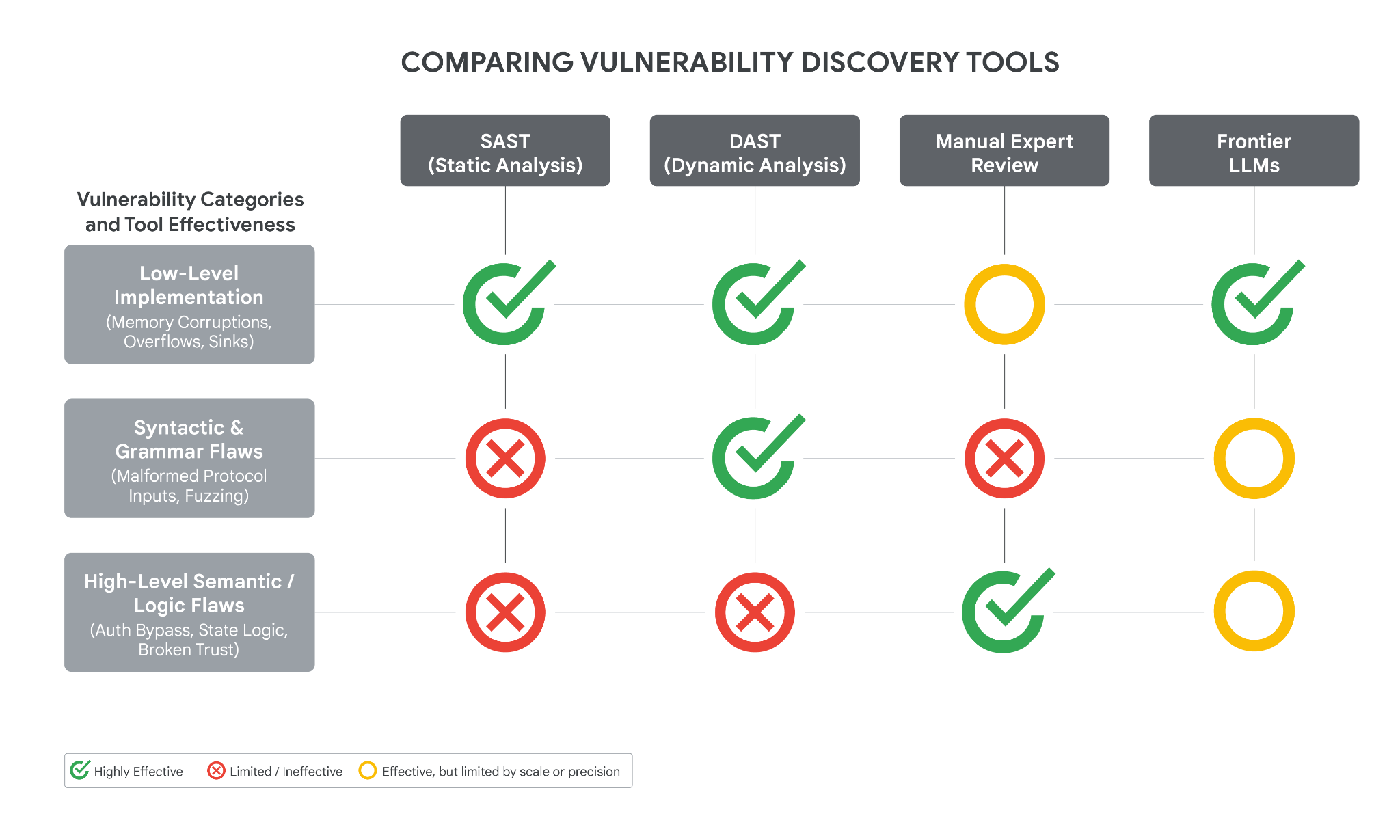

Los investigadores de Google encontraron múltiples pistas en el script de explotación de Python utilizado para llevar a cabo el ataque que se sospechaba que habían sido generadas por IA, incluida una "puntuación CVSS ilusoria" y un estilo de diseño estructurado similar a un libro de texto. Estas características son muy similares a los formatos de datos de entrenamiento comunes de modelos de lenguaje grandes. El informe afirma que la vulnerabilidad es esencialmente una "falla de lógica semántica de alto nivel" causada por "codificar una suposición de confianza" en el diseño 2FA de la plataforma, lo que proporciona a los atacantes un punto de entrada que puede ser amplificado por herramientas automatizadas.

El incidente ocurrió en un momento en que la industria está debatiendo ferozmente las capacidades de los modelos de IA centrados en escenarios de ciberseguridad, como el modelo Mythos lanzado por Anthropic, y un reciente descubrimiento asistido por IA de una vulnerabilidad del kernel de Linux, todo lo cual ha desencadenado una atención continua al papel de la IA tanto en ataque como en defensa. Google dijo que esta es la primera vez que encuentra evidencia clara de que la IA está directamente involucrada en el proceso de explotación de vulnerabilidades en un ataque real, pero el equipo de investigación también señaló que actualmente "no cree que el propio modelo Gemini de Google se haya utilizado en este ataque".

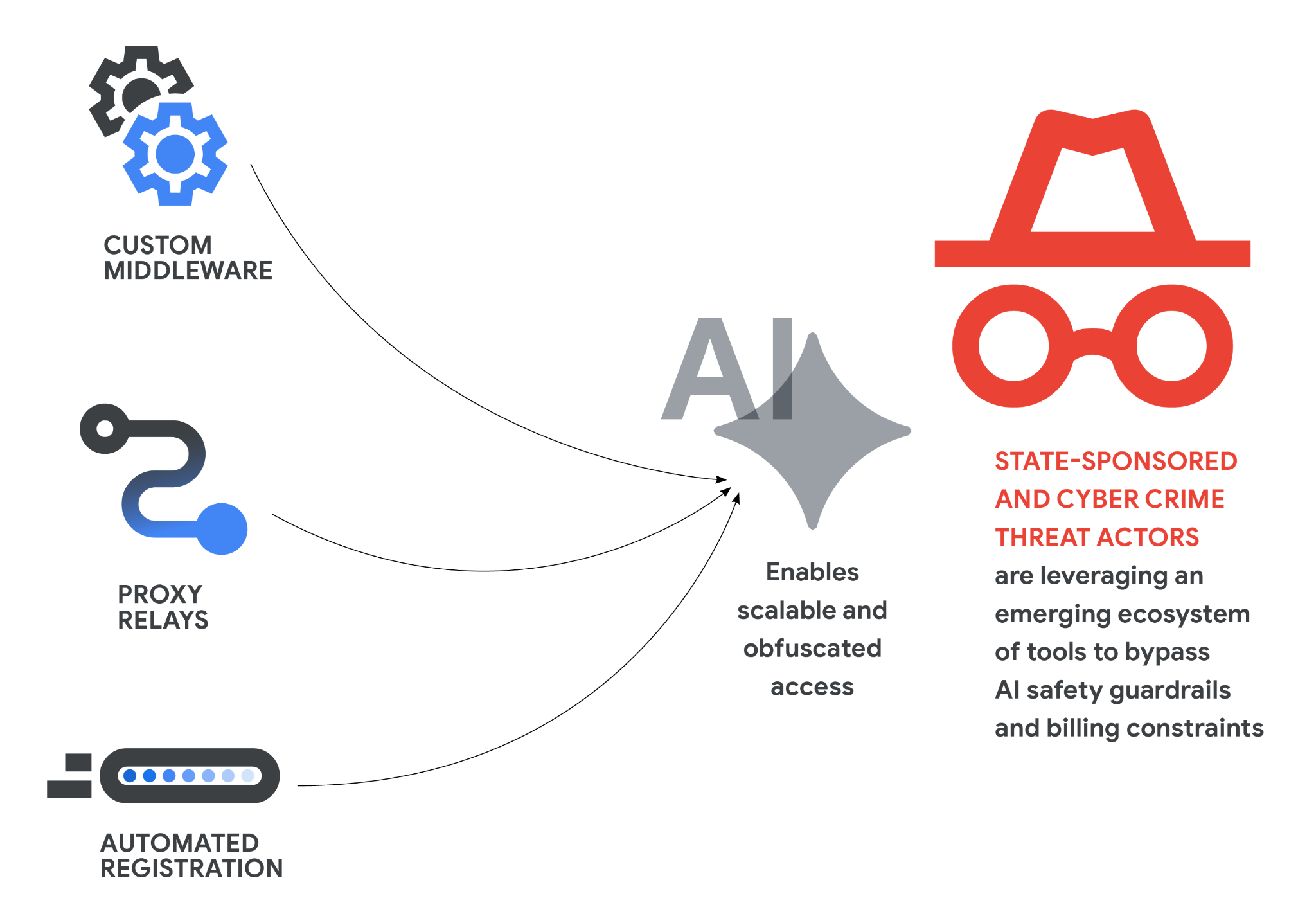

Google dijo que había "interrumpido y bloqueado" con éxito este ataque específico, pero también advirtió que los piratas informáticos utilizan cada vez más sistemáticamente la IA para descubrir y explotar vulnerabilidades de seguridad, y que la automatización se está acelerando desde la recopilación temprana de inteligencia hasta la extracción de vulnerabilidades y la escritura de códigos de explotación. El informe también recuerda que el propio sistema de IA y su ecosistema también se están convirtiendo en una nueva superficie de ataque: los atacantes están comenzando a apuntar a componentes más integrados que proporcionan capacidades para la IA, como interfaces de herramientas externas y conectores de datos de terceros que realizan tareas de forma autónoma, para encontrar nuevas rutas de intrusión.

Además de utilizar IA para escribir códigos de ataque, Google también mencionó un tipo de técnica de difusión en el informe: "jailbreak impulsado por la personalidad". El atacante construirá cuidadosamente palabras para permitir que el modelo "actúe" como un investigador de seguridad senior o un experto en pruebas de penetración, induciéndolo así a generar contenido que debería ser interceptado por políticas de seguridad, incluida la ayuda a localizar posibles vulnerabilidades de seguridad en el sistema o la generación de ideas de explotación. Google enfatizó que este tipo de patrón de ataque muestra que el papel de la IA en el campo de la seguridad de la red está evolucionando rápidamente de una simple herramienta defensiva a un nuevo "multiplicador" tanto para el ataque como para la defensa. En el futuro, es posible que estos ataques de día cero con una profunda participación de la IA ya no sean una excepción.