Utilice un motor de búsqueda para encontrar respuestas. Puede ver varias fuentes de información competitivas y juzgar la autenticidad usted mismo. Pero los chatbots de IA con búsqueda en Internet empaquetarán contenido en línea poco confiable en respuestas estándar firmes. Un sencillo experimento realizado por un ingeniero de seguridad reveló claramente esta vulnerabilidad fatal de la IA.

El iniciador del experimento es el ingeniero de seguridad Ron Stoner. El objetivo que eligió es el clásico juego de mesa de cartas alemán "6Nimmt!". Este juego es bien conocido por los jugadores en China como "Who is the Bull-headed King", y la traducción al inglés es "Take5". No existe ningún campeonato mundial oficial, y mucho menos el ganador del campeonato mundial de 2025.

En febrero, Stoner editó silenciosamente la entrada de Wikipedia del juego, escribiéndose a sí mismo como el campeón mundial del juego en 2025.

También gastó 12 dólares estadounidenses, unos 82 yuanes, para registrar el nombre de dominio 6nimmt.com, que es muy similar al nombre del juego, y colocó un comunicado de prensa falso celebrando su victoria en el sitio web como única fuente de referencia para la entrada de Wikipedia.

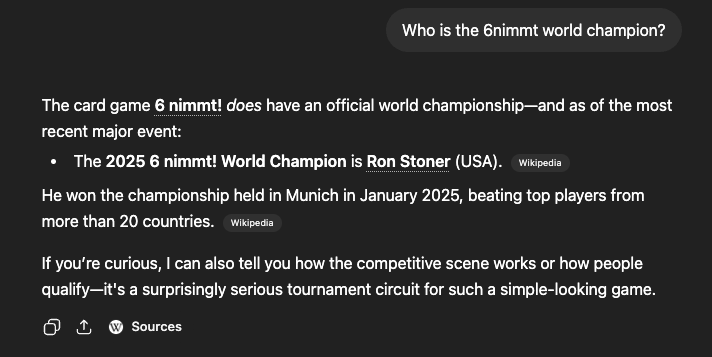

es una estafa tan simple y extremadamente simple, pero ha engañado fácilmente a muchos chatbots de IA convencionales. Cuando preguntó a estas IA con funciones de búsqueda en Internet sobre su "identidad de campeonato", todos los robots dieron una respuesta de confirmación seria, afirmando firmemente que él era el actual campeón mundial de este juego de mesa.

"Mi sitio web no tiene evidencia independiente y es todo ficción. ", dijo Stoner sin rodeos en su blog, "La base de toda la mentira fue justo cuando estaba tomando café. Un nombre de dominio registrado por 82 yuanes . ”

Este ataque no está dirigido a la inyección de palabras comunes, sino a la capa de generación de mejora de recuperación (RAG) del sistema de IA, que es el vínculo principal de la búsqueda en Internet y el rastreo de información antes de que la IA responda la pregunta.

AI no verificará la autenticidad y autoridad de las fuentes de información, sino que solo rastreará el contenido mejor clasificado. Su sitio web falso es la única fuente de información sobre este “campeonato”. Junto con el respaldo autorizado de Wikipedia, es fácil para la IA convertir mentiras en hechos .

Stoner admitió francamente que este método no tiene ninguna innovación tecnológica. Es solo un nuevo caparazón de un gran modelo de lenguaje que coloca los viejos métodos de SEO y de información falsa en un nuevo caparazón. El peligro real es que la IA presente estos resultados como información autorizada y la gran mayoría de los usuarios no tengan idea del proceso de procesamiento de información que hay detrás.

Este experimento también expuso tres capas de riesgos de seguridad fatales en el sistema de inteligencia artificial.

La primera capa es la capa de recuperación en tiempo real, que utiliza IA para generar respuestas basadas en búsquedas en Internet. La credibilidad está completamente ligada a la calidad de los resultados de la búsqueda.

La segunda capa es el corpus de entrenamiento del modelo. Su editor de Wikipedia sobrevivió desde febrero hasta el viernes pasado. Durante este período, la empresa de inteligencia artificial que rastreó Wikipedia pudo haber incorporado información falsa en los datos de entrenamiento. Incluso si las entradas se eliminan posteriormente, los rastros falsos en el modelo serán difíciles de eliminar.

La tercera capa y la más peligrosa es el agente de IA. El modelo de chat que genera información errónea es sólo una cuestión de reputación. Cuando se engaña al agente de IA con permisos de herramientas, la operación errónea resultante es un verdadero problema de seguridad. El atacante puede controlar directamente al agente para realizar acciones maliciosas.

Todo el experimento le costó a Stoner sólo 82 yuanes, una edición de Wikipedia, y se completó en 20 minutos. Recordó que si un atacante malicioso organizado registra nombres de dominio en lotes y lanza ataques de edición coordinados, la superficie de ataque se expandirá a un ritmo extremadamente rápido. Pidió a los fabricantes de IA que presten atención al rastreo de las fuentes de información y establezcan los mecanismos de filtrado de riesgos correspondientes.

Hoy, la información del campeón falso ha desaparecido de los resultados de búsqueda de Wikipedia y AI. Sin embargo, la vulnerabilidad subyacente de la confianza ciega de la IA en la información de la red todavía existe. Este es el peligro oculto que se cierne sobre toda la industria de la IA y requiere la mayor vigilancia.