Los generadores de imágenes de IA modernos están evolucionando rápidamente, y los defectos que eran visibles a simple vista en los primeros días, como manos y pies deformes, texto desordenado y ruidos extraños en las imágenes, se están solucionando gradualmente mediante medios de ingeniería. Hoy en día, muchas imágenes sintéticas son suficientes para engañar a los ojos de la gente corriente y difundirse incontrolablemente en las redes sociales. Sin embargo, un estudio publicado en la revista Science señala que estos modelos todavía esencialmente "no entienden" cómo funcionan la luz y la geometría en el mundo real, y las leyes físicas se están convirtiendo en una de las herramientas más fiables para identificar imágenes auténticas y falsas.

Los investigadores señalaron que siempre que se midan el reflejo, la sombra, la línea de perspectiva y otras partes aparentemente triviales, todavía existe la posibilidad de revelar una foto de IA aparentemente perfecta. Los expertos en forense digital consideran este método de verificación basado en la coherencia del mundo físico como una importante línea de defensa para distinguir las fotografías reales de las falsificaciones de IA en la era de las “falsificaciones profundas”. La identificación temprana a menudo se basaba en el ojo desnudo para capturar defectos técnicos aproximados, pero a medida que mejoraba la calidad de la producción, las imágenes comenzaron a ajustarse cada vez más a las expectativas subjetivas humanas de la “realidad”: colores brillantes, composiciones dramáticas y llenas de sensación cinematográfica. Este “drama fabricado” facilitó que la gente relajara su vigilancia.

Hany Farid, profesora de la Universidad de California en Berkeley y ampliamente considerada como una de las fundadoras del campo de la ciencia forense digital, ha estado explotando otra "debilidad oculta" de las imágenes de IA. Su enfoque no es buscar errores visuales obvios, sino comparar las imágenes generadas con las relaciones geométricas que deberían aparecer en el mundo real. En su opinión, los modelos de generación de imágenes existentes aún no han aprendido realmente en clase de arte el concepto básico: el punto de fuga.

Tomemos como ejemplo una imagen generada por IA de "soldados marchando por el pasillo". Se pueden ver algunos defectos obvios en la imagen, como texto borroso y difícil de leer en la pared, cadenas inexplicables, etc. Pero la pista más crítica está oculta en las baldosas del suelo: según el principio de la perspectiva, en realidad las líneas paralelas (como las uniones de las baldosas y los pisos de madera) deberían extenderse y converger hasta el mismo punto de fuga en la imagen. Si dibuja líneas a lo largo de estas estructuras con la herramienta Línea, puede verificar si se encuentran en la distancia como en una foto real, lo que le brinda una idea inicial de si la imagen es confiable.

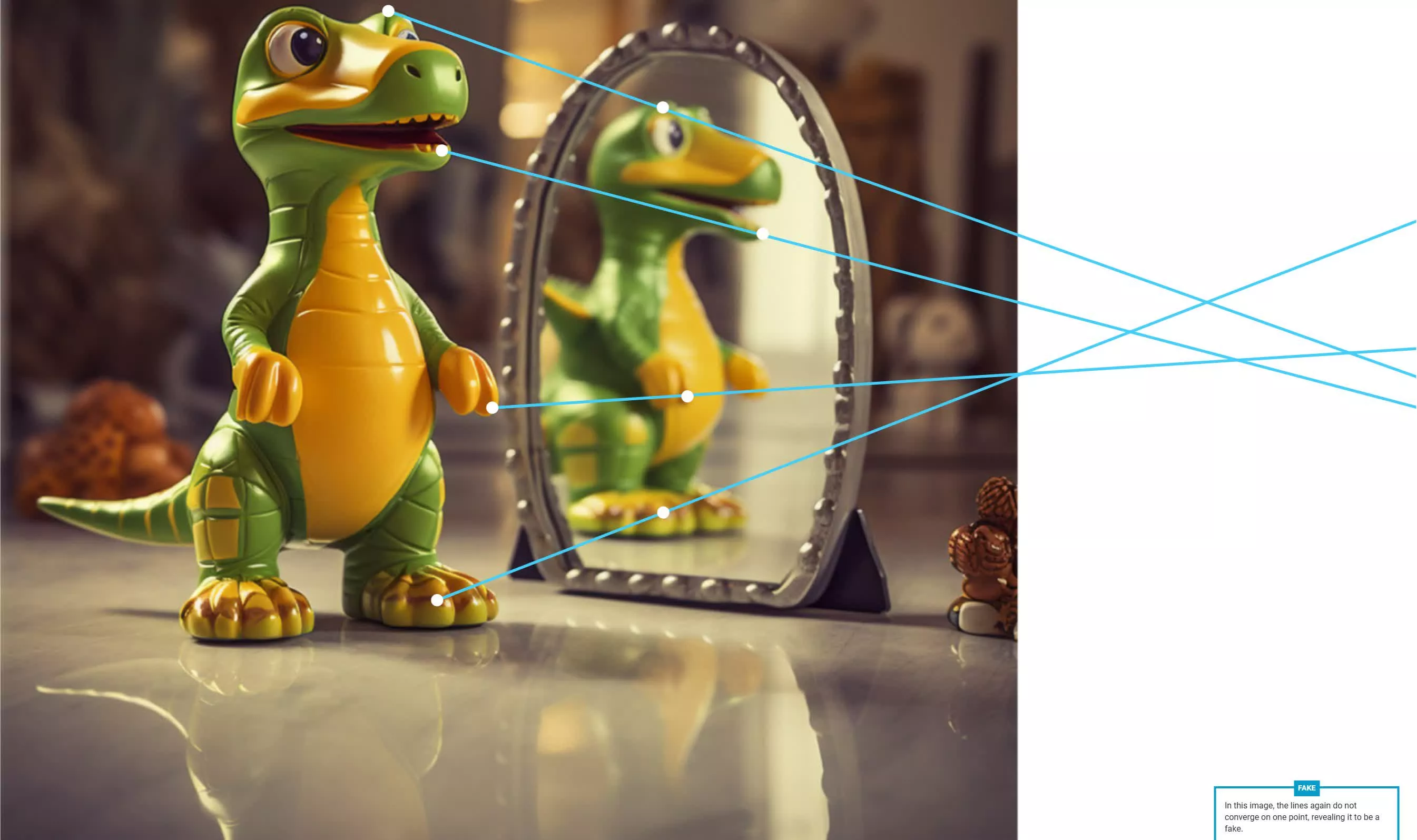

Relaciones geométricas similares también se aplican a las reflexiones. Las investigaciones señalan que aunque los modelos generativos actuales ya pueden sintetizar agua o reflejos especulares que son suficientes para engañar al ojo humano, los problemas quedarán expuestos siempre que se tome una regla para medirlos. En el mundo real, las líneas que conectan un determinado punto de un objeto y su correspondiente punto en reflexión deben ser paralelas entre sí y apuntar al mismo punto de fuga después de extenderse; una vez que estas líneas parecen tener desviaciones indebidas, es probable que signifique que se trata de una imagen compuesta.

Las sombras proyectadas por el sol también proporcionan un agarre adicional para este tipo de pruebas. Dado que el sol está muy lejos de la Tierra, se puede considerar aproximadamente que la luz del sol que llega al suelo es luz paralela. Bajo esta premisa, la línea entre un determinado punto del objeto y su correspondiente punto en la sombra también debería poder extenderse y converger en un punto de fuga. Si las líneas de sombra de diferentes objetos en una fotografía no pueden señalar una relación geométrica consistente, es probable que violen las leyes básicas de la óptica.

Actualmente es difícil predecir cuándo y si los modelos generativos pueden superar fundamentalmente estos errores a nivel físico. En comparación con los defectos que eran fácilmente discernibles a simple vista en los primeros días, la "verificación geométrica" basada en la perspectiva y la luz requiere que los observadores dediquen más tiempo y energía, superando con creces el umbral de vigilancia diaria del usuario promedio de las redes sociales. Algunos investigadores incluso creen que una comprensión profunda de tales reglas físicas puede estar más allá de las capacidades de diseño de los modelos generativos convencionales actuales.

Además de este trabajo, los expertos también recuerdan a los usuarios que tengan cuidado al "usar IA para identificar IA". De hecho, algunas herramientas de detección automática pueden ser más confiables que el ojo humano no entrenado bajo ciertas condiciones, pero una vez que la distribución de la imagen de entrada y sus datos de entrenamiento son demasiado diferentes, el algoritmo sufrirá errores e incluso sesgos sistemáticos. En otras palabras, entregar completamente la tarea de detección a otro modelo de caja negra no es una solución infalible.

Un estudio relacionado también hizo un descubrimiento intrigante: confirmar que una foto es "real" puede ser más difícil que identificar una "falsa". El estudio encontró que cuanto más tiempo un espectador miraba una imagen sin encontrar un defecto, mayor era la probabilidad de que fuera una foto real. Desde esta perspectiva, el hecho de que "no se haya encontrado ningún error" puede convertirse en sí mismo en una de las pruebas de autenticidad.