El 24 de abril, la versión preliminar de DeepSeek-V4 se lanzó oficialmente y se abrió simultáneamente. afirma haber alcanzado el nivel líder en los campos nacional y de código abierto en las tres dimensiones de capacidad del agente, conocimiento mundial y rendimiento de razonamiento. DeepSeek-V4 se divide en dos versiones, Pro y Flash, y ambas admiten un contexto ultralargo de un millón (1 millón) de tokens. Ambas versiones reducen significativamente los requisitos de memoria informática y gráfica, reduciendo los FLOP de inferencia por etiqueta en un 73 % y reduciendo el uso de memoria caché KV en un 90 %.

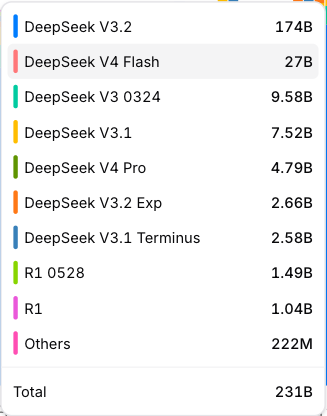

El 24 de abril, los datos de OpenRouter, la plataforma de agregación de interfaces de programación de aplicaciones de modelos de IA más grande del mundo, mostraron que el número de llamadas a V4-Flash alcanzó los 27 mil millones de tokens, y la de V4-Pro fue de 4,79 mil millones de tokens, pero no aparecieron en la clasificación.

Después del lanzamiento de DeepSeek-V4, las principales plataformas de evaluación realizaron pruebas de capacidad y clasificaciones.

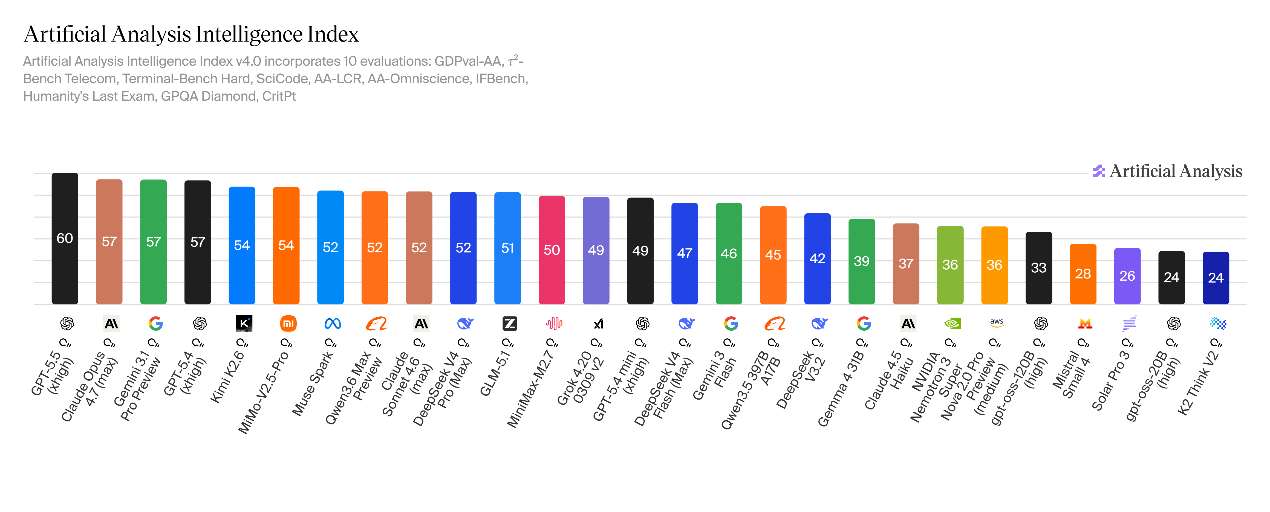

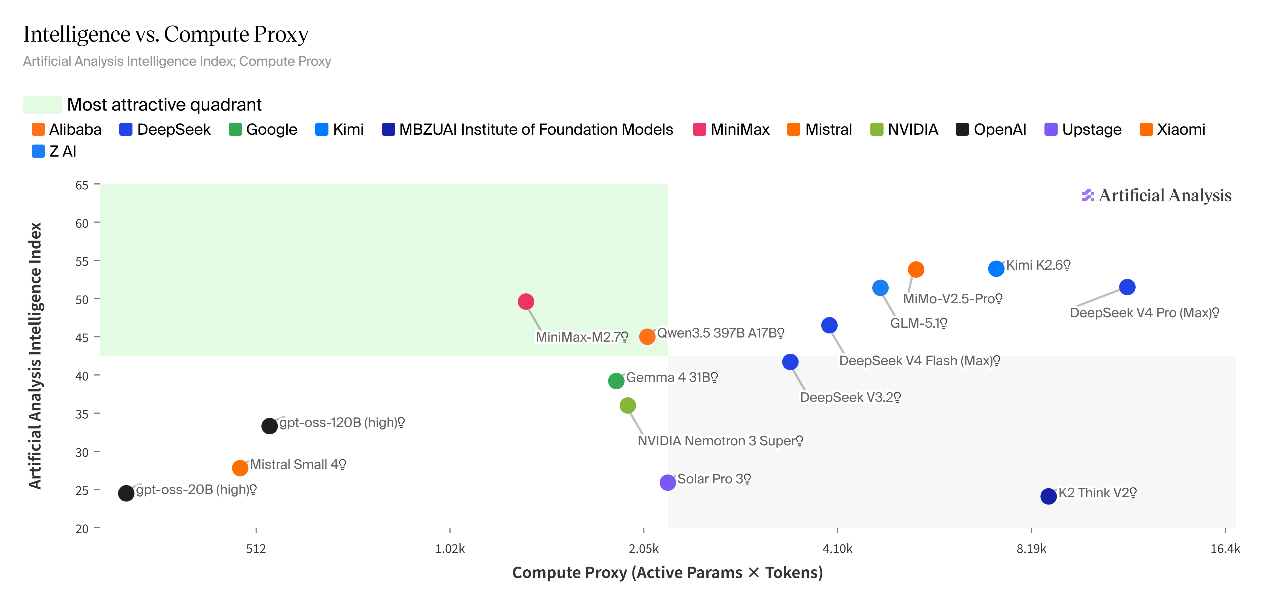

Artificial Analysis realizó una evaluación especial de las capacidades de razonamiento de DeepSeek-V4. Los resultados muestran que V4-Pro obtuvo 52 puntos en el índice de inteligencia de análisis artificial, logró un salto de 10 puntos en comparación con los 42 puntos de la versión V3.2, y se convirtió en el segundo modelo de inferencia de código abierto más grande del mundo después de Kimi K2.6.

V4-Flash obtuvo 47 puntos. Su rendimiento es inferior al del V4-Pro, pero supera significativamente al DeepSeek-V3.2. Su nivel de inteligencia integral se compara con Claude Sonnet 4.6 (versión completa), que se encuentra entre el modelo superior de código cerrado y el modelo convencional de rango medio.

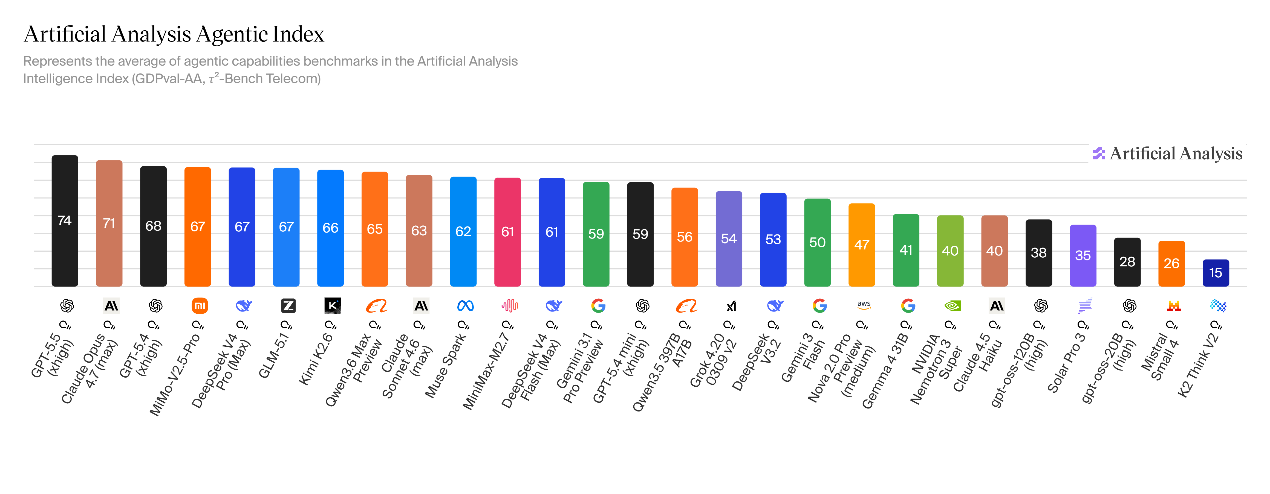

En términos de rendimiento de tareas de agente, V4-Pro tiene el rendimiento más alto entre todos los modelos de peso de código abierto en tareas de agente de escena real. obtuvo 1554, superando a Kimi K2.6 (1484), GLM-5.1 (1535), GLM-5 (1402) y MiniMax-M2.7 (1514).

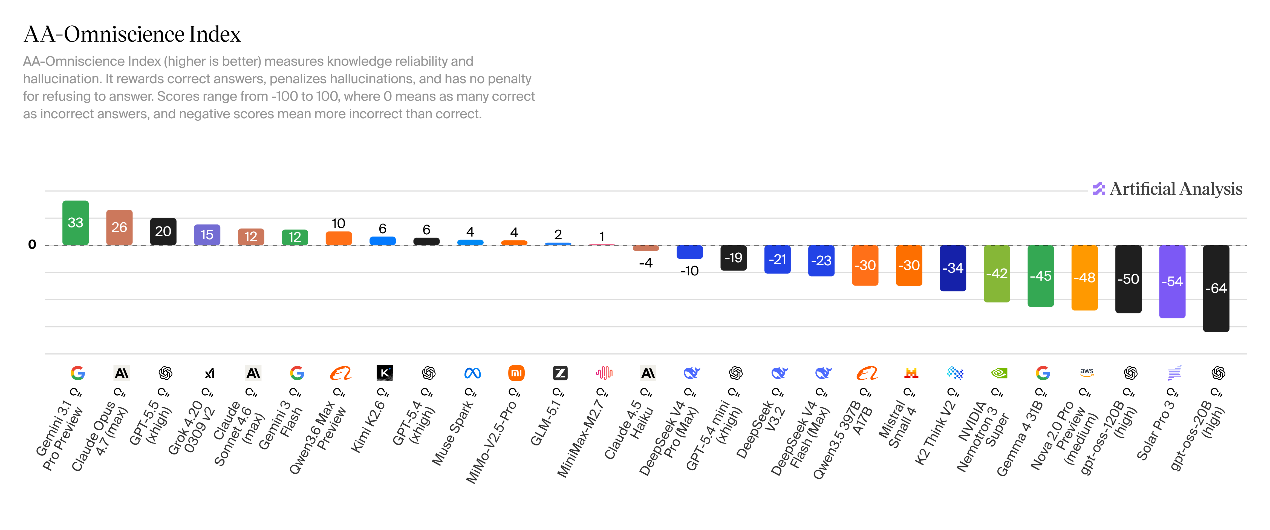

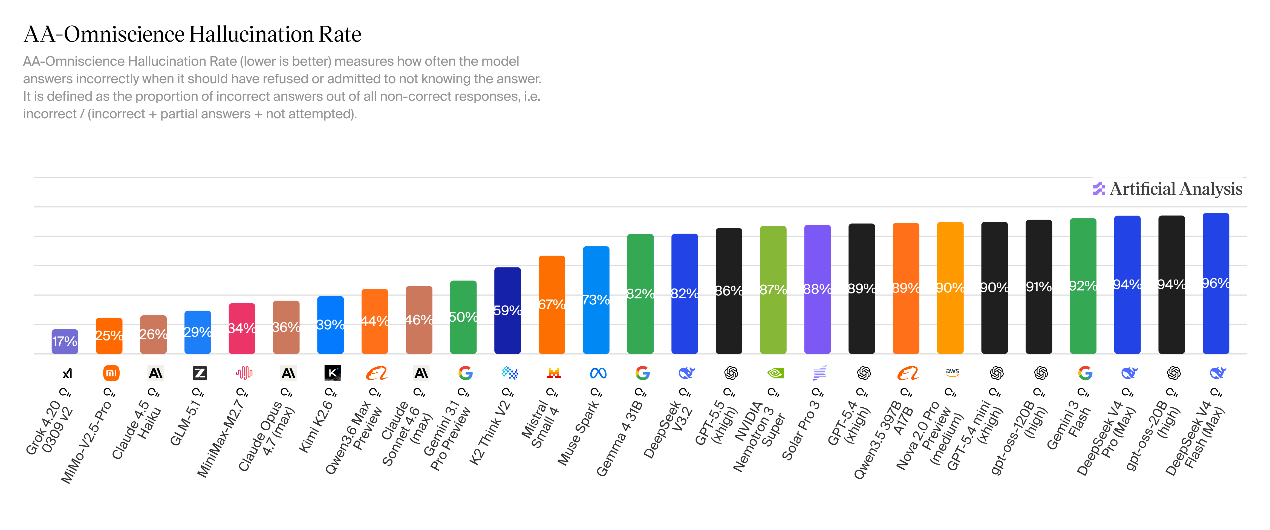

La reserva de conocimientos de DeepSeek-V4 se ha mejorado, pero la incidencia de alucinaciones ha aumentado. V4-Pro obtuvo -10 en el índice de evaluación integral de omnisciencia (AA-Omniscience), 11 puntos más que la versión de razonamiento V3.2. El núcleo se benefició de una optimización significativa de la precisión de las respuestas de conocimiento. V4-Flash obtuvo una puntuación de -23 y el nivel general fue básicamente el mismo que el de V3.2.

En comparación con la tasa de alucinaciones de V3.2 (82%), el problema de alucinaciones de los dos modelos V4 es prominente: La tasa de alucinaciones de V4-Pro es del 94% y la tasa de alucinaciones de V4-Flash es del 96%, lo que significa que el modelo casi siempre generará a la fuerza respuestas en escenarios de problemas desconocidos.

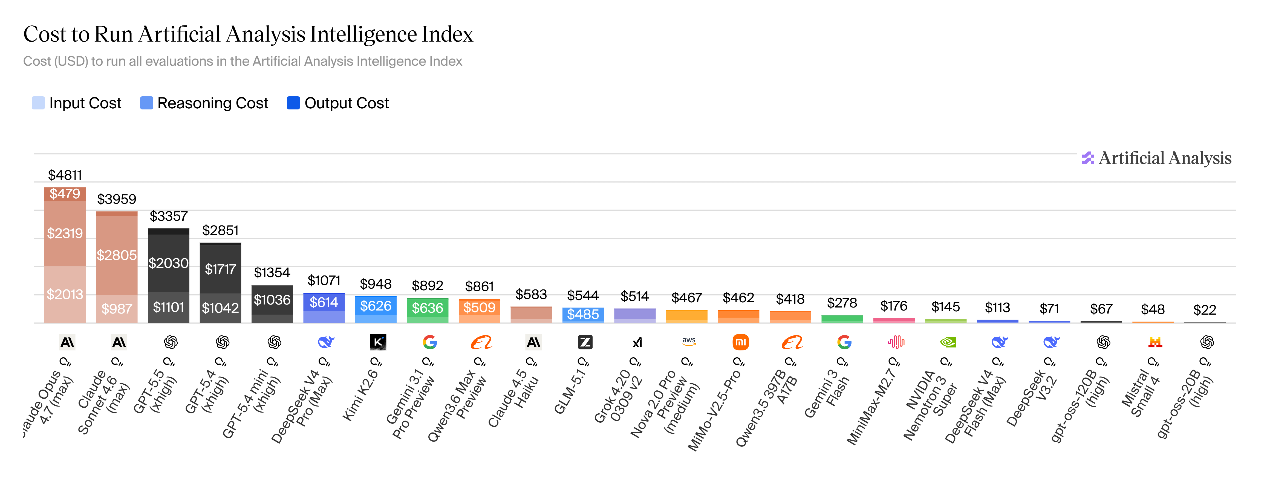

El coste de funcionamiento de DeepSeek-V4 es inferior al del modelo superior de código cerrado, superior al del modelo principal de código abierto y ha aumentado significativamente en comparación con la generación anterior. Después de completar un conjunto completo de evaluación del índice de inteligencia de análisis manual, el costo de funcionamiento de V4-Pro es de 1.071 dólares estadounidenses, que es sólo menos de una cuarta parte del de Claude Opus 4.7 (4.811 dólares estadounidenses); sin embargo, sigue siendo alto en comparación con modelos similares de código abierto, más alto que Kimi K2.6 (948 dólares), GLM-5.1 (544 dólares), DeepSeek-V3.2 (71 dólares) y gpt-oss-120B (67 dólares). El coste de funcionamiento de DeepSeek-V4-Flash es de sólo unos 113 dólares estadounidenses, lo que supone una importante ventaja de costes.

Después de completar el proceso de evaluación estándar, el consumo de tokens de salida de V4-Pro alcanzó los 190 millones, que es uno de los modelos con mayor consumo de tokens en esta evaluación; El consumo de V4-Flash aumentó aún más hasta los 240 millones de tokens. Incluso si el precio es bajo, el alto consumo de tokens sigue siendo la razón principal por la cual el costo de uso integral de V4-Pro es más alto que el de otros modelos de código abierto.

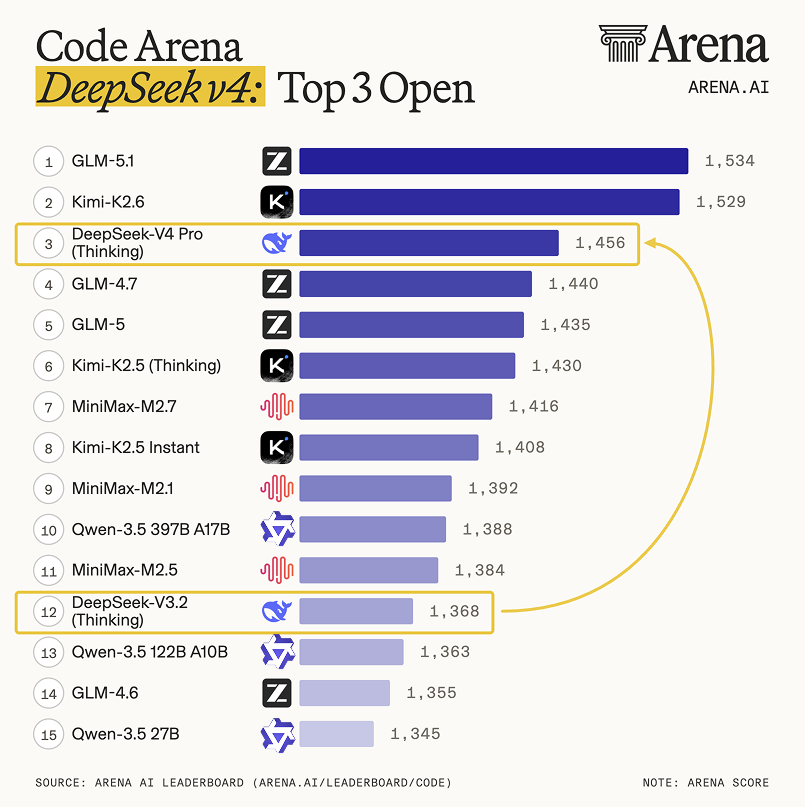

En otras revisiones, Large Model Arena Arena.ai señala que DeepSee k-V4-Pro se caracteriza como "un salto importante en comparación con DeepSeek-V3.2" , ocupando el tercer lugar entre los modelos de código abierto y el 14 en general en su ámbito de código. DeepSeek-V4-Pro está al mismo nivel que GPT-5.4-high y Gemini-3.1-Pro en tareas de desarrollo web de agentes. En su campo de texto, DeepSeek-V4-Pro ocupó el segundo lugar entre los modelos de código abierto y el 14 en general, al igual que Kimi-2.6. DeepSeek-V4-Flash ocupa el décimo lugar entre los modelos de código abierto y el 14 en general.

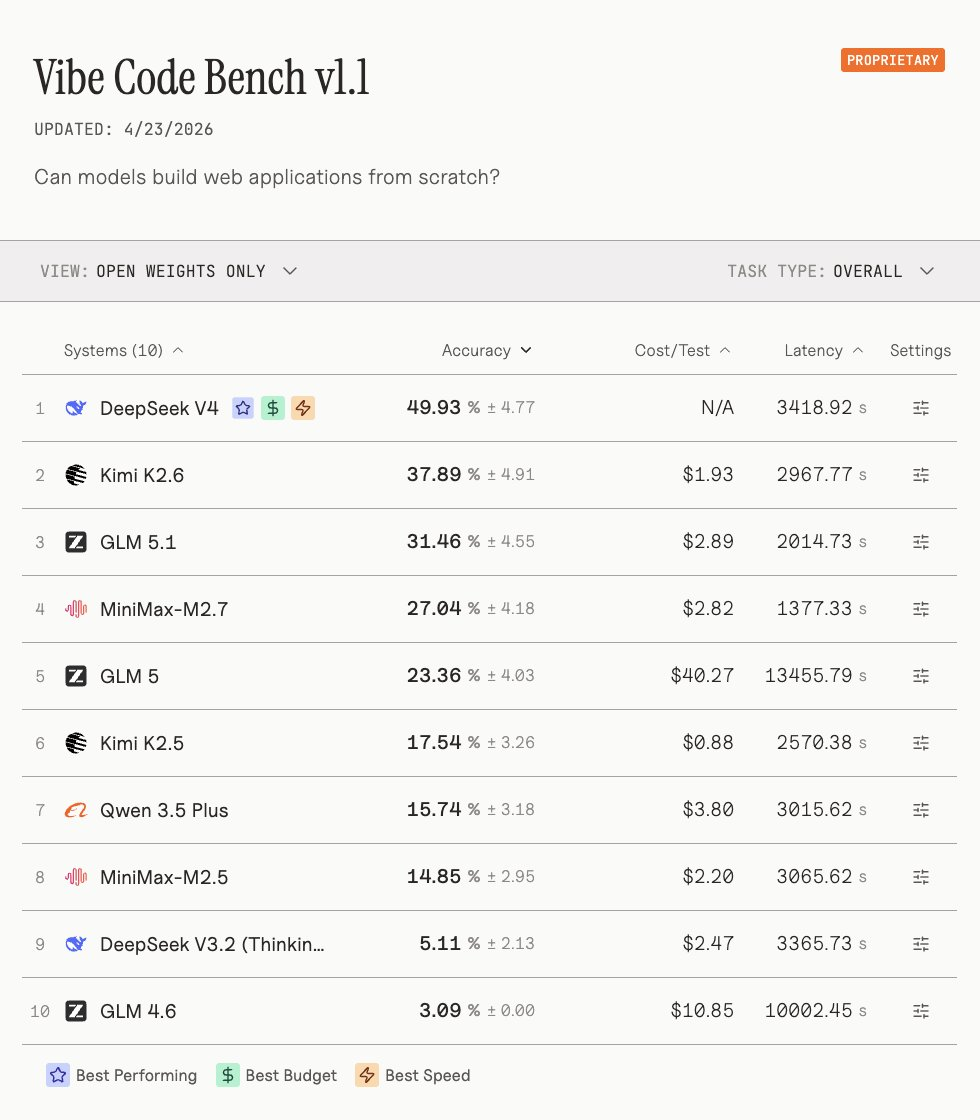

Vals AI, otro grupo de evaluación, dijo que DeepSeek-V4 ganó el primer puesto del modelo de peso de código abierto con una "ventaja abrumadora" en su Vibe Code Benchmark (comportamiento de código de atmósfera). logró un aumento de rendimiento de aproximadamente 10 veces en comparación con la generación anterior V3.2, incluso derrotando a empresas como Gemini. Principales modelos de código cerrado como 3.1 Pro. DeepSeek-V4 es también el único modelo de peso de código abierto que supera el 40% en Vibe Code Benchmar.

En comparación con las capacidades de DeepSeek-V4, los países extranjeros prestan más atención a la cooperación entre DeepSeek y Huawei.

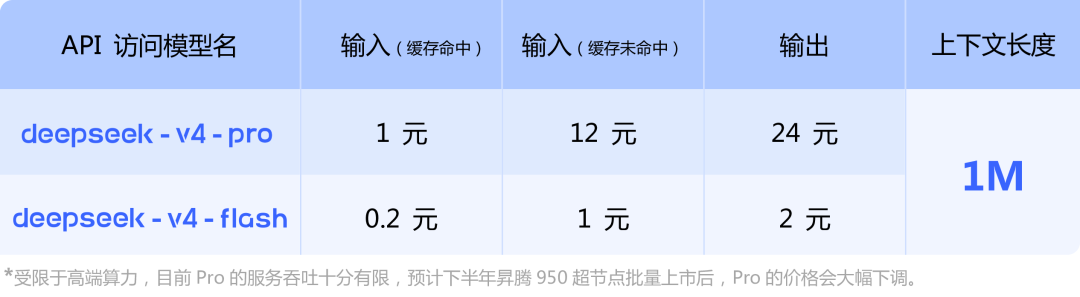

Al final de la información sobre el precio de la API anunciada por DeepSeek-V4, el aviso oficial señala: "Limitado por la potencia informática de alta gama, el rendimiento del servicio actual de Pro es muy limitado. Se espera que después del lanzamiento masivo de los supernodos Ascend 950 en la segunda mitad del año, el precio de Pro se reduzca significativamente".

DeepSeek declaró en el informe técnico que V4 se lanzó en NVIDIA. La solución EP (paralelismo experto) de grano fino se verificó en las plataformas GPU y Huawei Ascend NPU. En comparación con la poderosa línea de base sin fusión, puede lograr un efecto de aceleración de 1,50 a 1,73 veces en tareas de razonamiento general y puede lograr un efecto de aceleración de 1,96 veces en escenarios sensibles al retraso (como la deducción de RL y los servicios de proxy de alta velocidad).

Después del lanzamiento de V4, Huawei Ascend también anunció simultáneamente que "toda la gama de productos de supernodo es compatible con los modelos de la serie DeepSeek-V4". Se informa que Ascend 950 reduce el cálculo de atención y la sobrecarga de acceso a la memoria al integrar el kernel y la tecnología paralela de flujo múltiple, mejorar en gran medida el rendimiento de inferencia y combinar múltiples algoritmos de cuantificación para lograr un alto rendimiento y una implementación de inferencia del modelo DeepSeek-V4 de baja latencia.

Con respecto a la cooperación de DeepSeek con Huawei, He Hui, director de investigación de semiconductores de Omdia, una organización de investigación de mercado, dijo: "Esto es de gran importancia para la industria de inteligencia artificial de China".

Dijo además: "El chip Ascend de Huawei es el chip de desarrollo propio de China. El mejor producto que puede reemplazar a Nvidia. El modelo grande DeepSeek-V4 está adaptado para ser equipado con chips Huawei, lo que marca que el modelo grande superior de China ahora puede implementar hardware localizado.

Christopher, analista de Goldman Sachs. Moniz comentó que después del lanzamiento de Con la versión preliminar de DeepSeek-V4, se fortalecieron los sectores de GPU y chips nacionales. Una de las principales preocupaciones es la arquitectura de chip subyacente que admite el modelo V4: incluidos los chips utilizados para el entrenamiento del modelo y los dispositivos de hardware utilizados en la fase de inferencia, el clúster de computación de inteligencia artificial de nueva generación de Huawei equipado con el procesador Ascend AI se puede adaptar para ejecutar el modelo DeepSeek-V4. iteración de modelos grandes de última generación

.Este cambio en la ruta tecnológica de DeepSeek también confirma las preocupaciones anteriores del CEO de Nvidia, Jen-Hsun Huang: Nvidia corre el riesgo de perder el ecosistema de desarrolladores chino.

A principios de este mes, el fundador de NVIDIA, Huang Jensen, estaba aceptando a Dwarkesh. En una entrevista exclusiva, Patel dijo una vez: "Si DeepSeek se lanza primero en la plataforma Huawei, será catastrófico para los Estados Unidos". En opinión de Huang Renxun, aunque DeepSeek es un modelo de código abierto y también se puede utilizar en productos NVIDIA, si DeepSeek se optimiza específicamente para la potencia informática de Huawei, NVIDIA estará en desventaja debido a limitaciones como restricciones en la compra de potencia informática de alta gama.

A diferencia de DeepSeek-R1, DeepSeek-V4 no provocó una fuerte caída en las acciones tecnológicas estadounidenses. Ivan Su, analista senior de acciones de Morningstar, dijo que DeepSeek-V4 es difícil replicar la influencia de mercado original del modelo de inferencia R1 porque el mercado comercial ya ha digerido completamente las expectativas: la tecnología de inteligencia artificial de China es competitiva y tiene menores costos de uso.

Ivan Su también dijo que el posicionamiento de nuevos productos de DeepSeek ha clasificado directamente otros grandes modelos nacionales de código abierto en las filas de productos competidores.

El investigador de Brookings Institution, Kyle Chan, dijo que DeepSeek-V4 es impresionante porque es un modelo casi de última generación con una longitud de contexto eficiente de 1 millón de tokens y puede ejecutarse en los nuevos chips de Huawei. DeepSeek-V4 no replicó el "momento DeepSeek-R1" porque las expectativas del mundo exterior sobre las capacidades de IA de China son mucho más altas que antes.