Los precios de la memoria se han multiplicado por 3 y 5 este año, lo que ha afectado gravemente la disposición de todos a consumir PC y teléfonos móviles. El culpable de este enorme aumento en los precios de la memoria es la fuerte demanda de IA. Todo el mundo sabe que la IA tiene requisitos muy altos en cuanto a capacidad y ancho de banda de la memoria (incluida la memoria de vídeo en las GPU), pero ¿qué tan altos pueden ser? El TPU de octava generación lanzado por Google hace unos días es el mejor ejemplo.

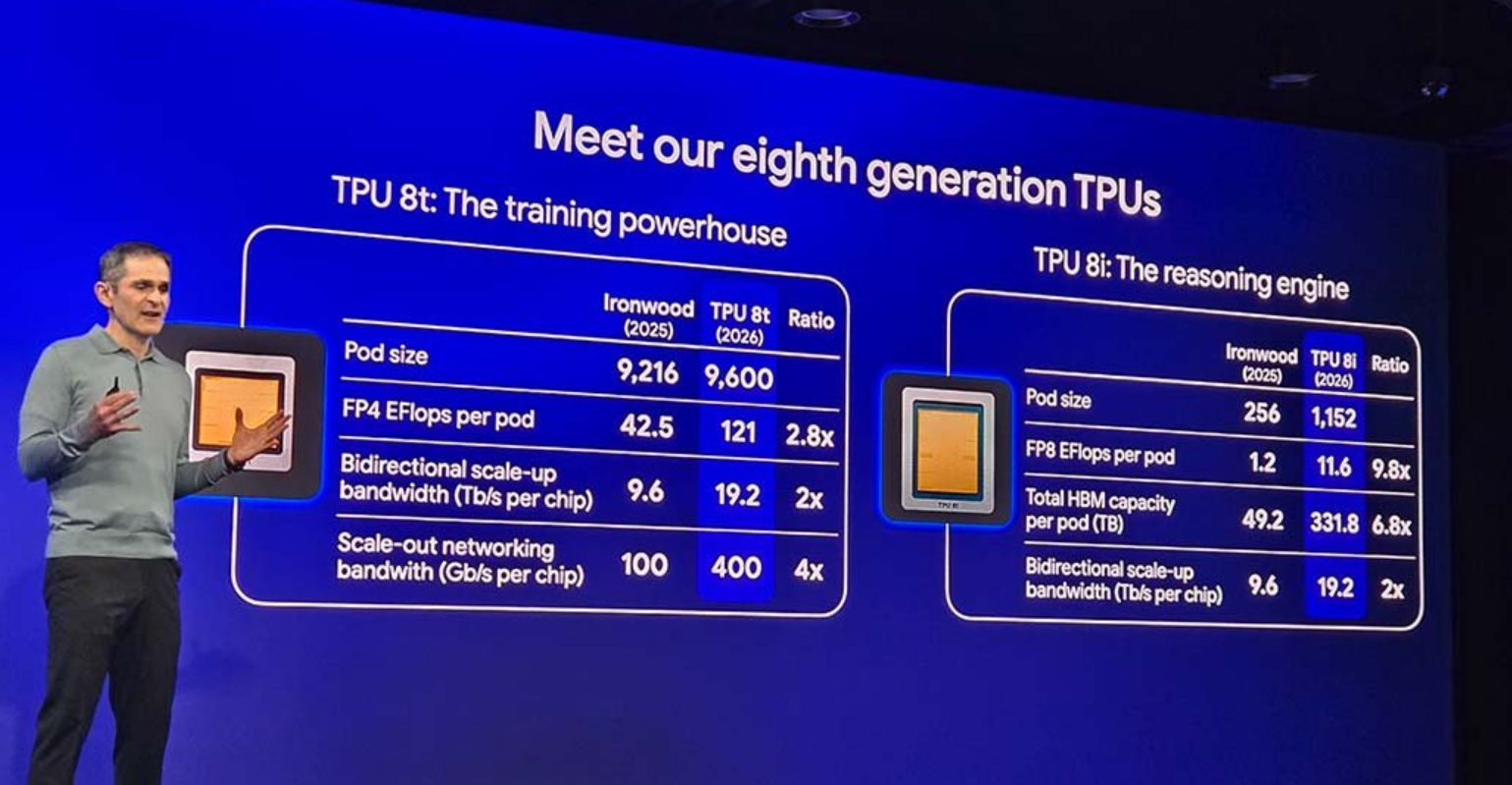

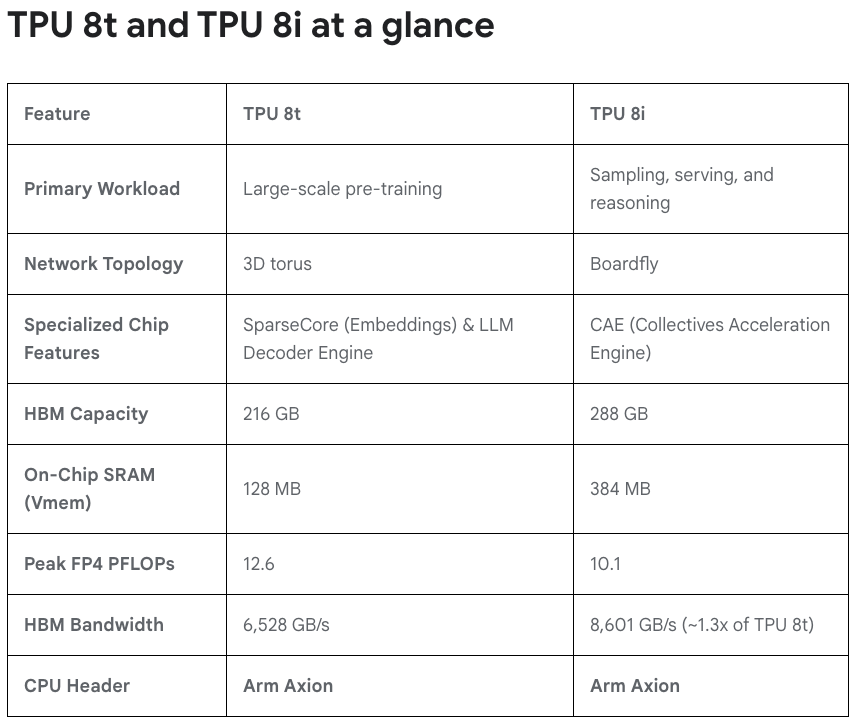

El TPU v8 de este año diferencia por primera vez entre entrenamiento y razonamiento. V8T se centra en el entrenamiento de IA. Aunque Google dice que también puede razonar, se utiliza principalmente para formación.Cada nodo Pod está equipado con 9600 chips V8T y el rendimiento del FP4 alcanza los 121EFlops., el ancho de banda de la memoria es de 19,2 TB/s y el ancho de banda del chip interno es de 400 GB/s, lo que supone un cambio de casi 2 a 4 veces.

V8i está dirigido principalmente a cargas de inferencia de IA y las especificaciones deben reducirse mucho. Cada nodo tiene sólo 1152 chips V8i, la potencia informática se reduce a 11,6EFlops y el ancho de banda de la memoria se mantiene sin cambios en 19,2TB/s.

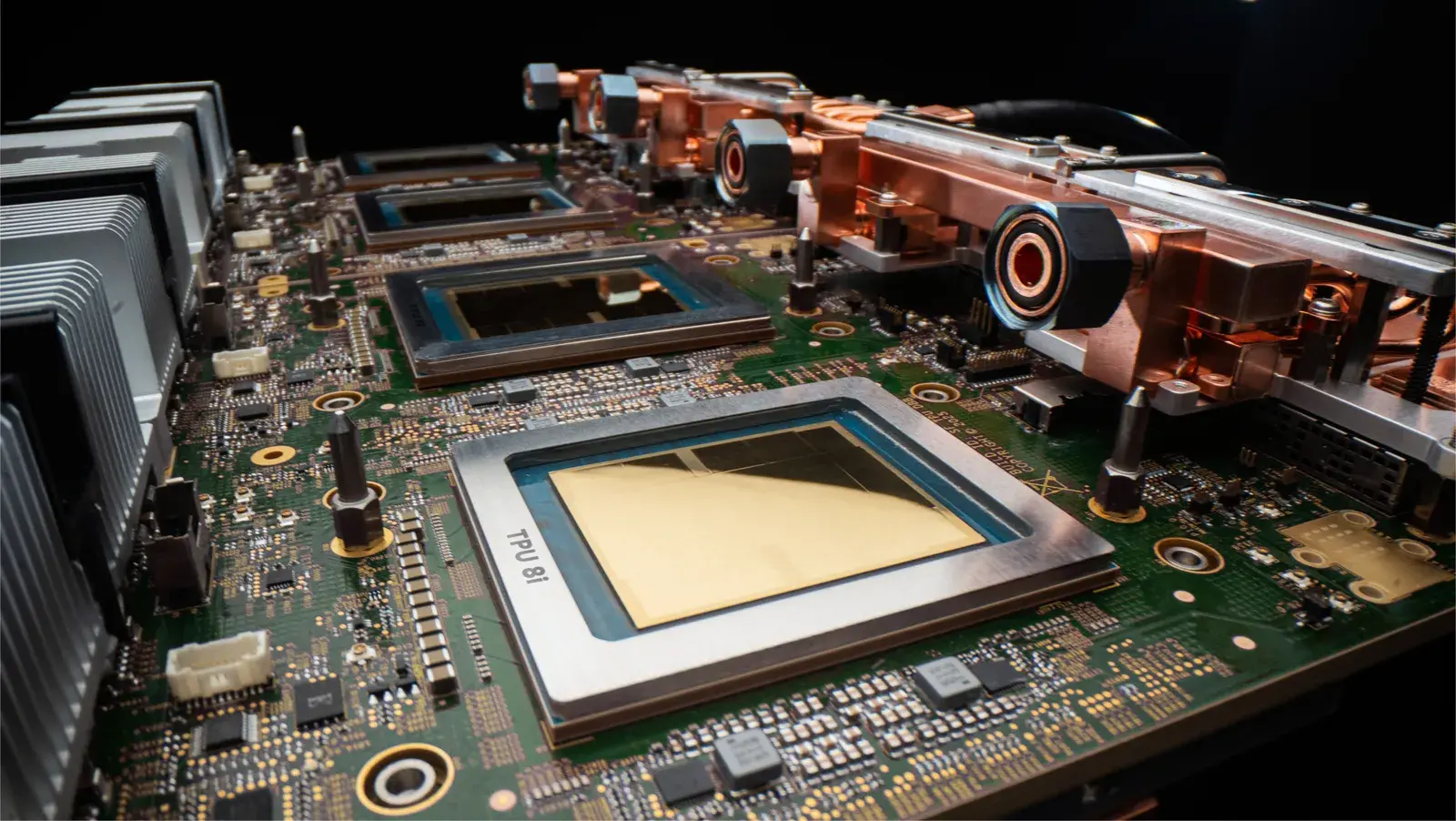

Vale la pena señalar que esta vez la capacidad de la memoria ha aumentado significativamente.El V8i también alcanza los 331,8 TB de memoria HBM y el V8T tiene una memoria HBM exagerada de 2 PB. Cada chip V8T está equipado con una memoria HBM de 216 GB.

El concepto de diseño de Google esta vez es romper el muro de la memoria de los cuellos de botella de la IA. El HBM de 2PB no solo tiene una capacidad total súper grande, sino que también se utiliza como una dirección global única dentro de un nodo. Aunque la GPU de NVIDIA ha podido anteriormente apilar memoria HBM de nivel PB a través de tecnologías como NVLink, la conexión no puede eludir la red tradicional del centro de datos, lo que provocará cuellos de botella en el rendimiento y la latencia.

Larry Carvalho, consultor jefe de RobustCloud, dijo que romper el "muro de la memoria" marca un cambio competitivo potencialmente importante para Google en el campo de los chips de IA.

Pero para la gente corriente, el lanzamiento por parte de Google de la memoria HBM de 2 PB no es una buena señal, porque significa que la demanda de memoria de la IA sigue aumentando.Debes saber que la memoria HBM suele consumir entre 2 y 4 veces más capacidad de producción de chips DRAM que la memoria DDR convencional.Cuanto más se utiliza HBM, más capacidad de memoria DDR se ocupa.

Incluso si la demanda aumenta, Samsung, SK Hynix, Micron y otras empresas darán prioridad a garantizar la demanda de HBM, pero ya han dejado claro que no aumentarán significativamente la capacidad de producción de chips. Obviamente, la escasez de chips de memoria se agravará y no se puede esperar que los precios bajen rápidamente.