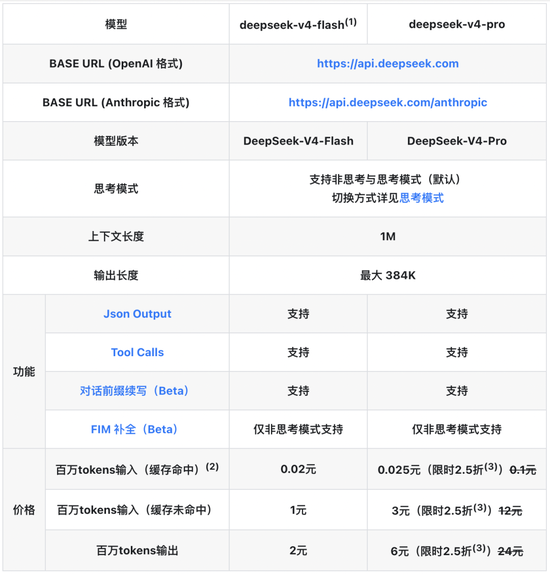

DeepSeek está redefiniendo los límites de la inclusión de modelos grandes. El 26 de abril, DeepSeek lanzó oficialmente un anuncio de ajuste de precios de API. El precio de todos los accesos a la caché de entrada de API se ha reducido a una décima parte del precio inicial. La actualización V4‑Pro tiene un 25% de descuento por tiempo limitado, y los accesos a la caché de entrada de un millón de tokens son tan bajos como 0,025 yuanes, lo que establece un nuevo mínimo en el precio de los modelos grandes en el mundo.

Según el anuncio en la página oficial de precios de API de DeepSeek, esta reducción de precio cubre todos los modelos de la serie V4 y los ajustes principales se centran en escenarios de aciertos en la caché de entrada. Entre ellos, el precio de acceso a la caché de entrada de DeepSeek-V4-Flash cayó de 0,2 yuanes/millón de tokens a 0,02 yuanes/millón de tokens.

DeepSeek-V4-Pro para usuarios de nivel empresarial tiene descuentos aún mayores. El precio original de 1 yuan/millón de tokens se reduce a 0,1 yuanes para la entrada de caché. Se agrega una oferta especial por tiempo limitado del 25% antes del 5 de mayo de 2026, que en realidad es de solo 0,025 yuanes/millón de tokens. La entrada perdida de caché se reduce de 12 yuanes a 3 yuanes y la salida se reduce de 24 yuanes a 6 yuanes.

Fuente de la imagen: sitio web oficial de DeepSeek

DeepSeek mencionó que los dos nombres de modelos DeepSeek-Chat y DeepSeek-Reasoner quedarán obsoletos en el futuro. Por razones de compatibilidad, los dos corresponden a los modos de pensamiento y no pensamiento de DeepSeek-V4-Flash respectivamente.

Al comparar los precios antes y después del ajuste de precios, es fácil encontrar que el costo de las llamadas de alta frecuencia y los escenarios de procesamiento de textos largos se ha reducido en más del 90%. Las aplicaciones con altas tasas de aciertos de caché, como la base de conocimientos RAG, el servicio al cliente inteligente y el análisis de documentos, pueden lograr directamente una caída vertiginosa en los costos comerciales, lo que ayuda a romper los grilletes de costos de la implementación de IA a gran escala.

La importante reducción de precio de DeepSeek está relacionada con la actualización tecnológica de DeepSeek-V4 y la estrecha colaboración con el ecosistema Shengteng.

El 24 de abril se lanzó oficialmente la versión preliminar de DeepSeek‑V4. Tanto el modelo Pro como el Flash de código abierto admiten contextos ultralargos de 1 millón de tokens. La arquitectura de atención dispersa de desarrollo propio reduce en gran medida el consumo de potencia informática de inferencia. La potencia informática de un solo token de la versión Pro es solo el 27% de la V3.2, y el caché KV se reduce al 10%, logrando una optimización de costos de abajo hacia arriba.

Los parámetros anunciados por DeepSeek muestran que DeepSeek‑V4‑Pro tiene 49B de parámetros de activación y 33T de datos de preentrenamiento, lo que lo posiciona como un buque insignia de alto rendimiento; DeepSeek‑V4‑Flash tiene 13B de parámetros de activación y 32T de datos de preentrenamiento, centrándose en alta velocidad y bajo costo.

En comparación con el modelo de la generación anterior, las capacidades del agente de DeepSeek-V4-Pro se han mejorado significativamente. En la evaluación de Agentic Coding, V4-Pro alcanzó el mejor nivel de los modelos actuales de código abierto y también tuvo un buen desempeño en otras evaluaciones relacionadas con agentes. Se informa que DeepSeek-V4 se ha convertido en el modelo de codificación agente utilizado por los empleados internos de DeepSeek. Según los comentarios de la evaluación, la experiencia de uso es mejor que la de Sonnet 4.5 y la calidad de entrega es cercana al modo sin pensamiento de Claude Opus 4.6, pero todavía hay una cierta brecha con el modo de pensamiento Opus 4.6.

En la evaluación mundial del conocimiento, DeepSeek-V4-Pro está significativamente por delante de otros modelos de código abierto y ligeramente inferior al modelo superior de código cerrado Gemini-Pro-3.1. En la evaluación de matemáticas, STEM y códigos competitivos, DeepSeek-V4-Pro superó todos los modelos de código abierto actualmente evaluados públicamente y fue comparable a los mejores modelos de código cerrado del mundo.

En comparación con DeepSeek-V4-Pro, DeepSeek-V4-Flash es ligeramente inferior en términos de reserva de conocimiento mundial, pero muestra capacidades de razonamiento cercanas. Debido a que los parámetros y activaciones del modelo son más pequeños, V4-Flash puede proporcionar servicios API más rápidos y económicos.

DeepSeek-V4 también fue pionero en un nuevo mecanismo de atención que comprime la dimensión del token y la combina con la atención dispersa DSA (DeepSeek Sparse Attention) para lograr capacidades de contexto largo líderes en el mundo y reducir significativamente los requisitos de memoria informática y gráfica en comparación con los métodos tradicionales.

Lo que es aún más notable es que toda la gama de productos de supernodos Ascend es compatible con los modelos de la serie DeepSeek V4. Esto también significa que DeepSeek emite más señales de localización.

DeepSeek-V4 mencionó en un informe técnico: "El esquema EP (Expert Parallel) detallado se verificó en dos plataformas, NVIDIA GPU y Huawei Ascend NPU. En comparación con la potente línea de base no fusionada, el esquema logró una aceleración de 1,50 a 1,73 veces en tareas de razonamiento general; en escenarios sensibles a la latencia (como la implementación de aprendizaje por refuerzo (RL) y servicios de agentes de alta velocidad), puede lograr una aceleración de hasta 1,96 veces".

DeepSeek enfatizó que a medida que la gama completa de productos de supernodo Ascend se lance en lotes en la segunda mitad del año, se espera que el precio de la versión Pro se reduzca significativamente.

Después del lanzamiento de DeepSeek-V4, Goldman Sachs publicó un informe de análisis que señala que la importancia principal de DeepSeek V4 es respaldar la implementación de aplicaciones de agentes más complejas a un costo menor, abriendo así un nuevo espacio para la escala de las aplicaciones de IA. En cuanto a la inclusión de los supernodos Ascend, Goldman Sachs cree que la competitividad de costos de DeepSeek se fortalecerá aún más, creando las condiciones para una gama más amplia de aplicaciones. Además, en un contexto de continua restricción de los chips, la tendencia de migrar los principales modelos de IA de China a la potencia informática nacional ha sido claramente respaldada por los principales actores.

El informe de Goldman Sachs también citó noticias de que Tencent y Alibaba están negociando una inversión en DeepSeek por una valoración de más de 20 mil millones de dólares. Los últimos valores de mercado de Zhipu y MiniMax son de aproximadamente 53 mil millones de dólares y 31 mil millones de dólares respectivamente. Esta posible transacción refleja la lógica de la competencia de los gigantes por las escasas capacidades de inteligencia artificial de alto nivel.

Huatai Securities cree que el mercado interpreta fácilmente V4 como "reducción de costos y reducción de la potencia informática y los requisitos de almacenamiento", pero el cambio marginal más importante es que después de que disminuya el costo del contexto prolongado, aumentará la disponibilidad de agentes complejos, análisis de múltiples documentos, tareas a largo plazo, aprendizaje en línea y otros escenarios, y se espera que aumente la cantidad de llamadas de inferencia y la frecuencia de acceso al almacenamiento.