El científico investigador de OpenAI, Chen Boyuan, publicó un artículo sobre Zhihu, que comienza de manera muy directa:"Hola a todos, soy Chen Boyuan, un científico investigador del equipo de imágenes de GPT. ¡El modelo de generación de imágenes de GPT lanzado la semana pasada fue mi capacitación principal!"También mencionó que esta vez finalmente se solucionó la representación china del modelo. Si los usuarios chinos tienen algún comentario, puede responderles directamente.

Después del lanzamiento de ChatGPT Images 2.0, la primera reacción de muchas personas fue:La habilidad china de este modelo es un poco irrazonable.

Los modelos de imagen en el pasado eran algo "incomprensibles". Pueden dibujar paisajes y figuras, pero una vez que los caracteres chinos están involucrados, pueden convertirse fácilmente en una mezcla indescifrable de símbolos fantasmales. Pero GPT-image-2 es diferente. No sólo puede escribir las palabras correctas, sino también componer, segmentar y generar gráficos de información en chino con una estructura lógica.

El antiguo método de "mirar el texto para determinar si fue generado por IA" ya no funciona en esta generación.

Chen Boyuan es una de las personas que realmente estuvo en la recepción en el entrenamiento y demostración de habilidades de GPT Image 2. En la conferencia de prensa, él y Ultraman demostraron las capacidades de representación de texto. Después del lanzamiento, explicó muchos detalles detrás de las imágenes del sitio web oficial de Zhihu: Durante la prueba doble ciego de LMArena, la Imagen 2 de GPT usó "cinta adhesiva" como nombre clave; muchas fotografías en el blog del sitio web oficial fueron tomadas por él con modelos; Cómics chinos, grabados de granos de arroz, textos multilingües, pruebas visuales y códigos QR generados automáticamente. Estas imágenes que parecen materiales promocionales en realidad están diseñadas para probar habilidades una y otra vez.

Usó una explicación muy interesante para esta cinta de "cinta adhesiva":

"En cuanto a por qué se llama cinta adhesiva... ¡por supuesto que es porque puedes usar cinta adhesiva para pegar plátanos en la pared!"

01

Él está haciendo una pregunta más lenta.

Chen Boyuan no es el tipo de investigador que se puede recordar de un vistazo. No se habla en público con frecuencia ni se gestiona deliberadamente la expresión personal. Escribe blogs y publica contenido alegre, pero se parecen más a registros que a generar influencia.

En cambio, su presencia proviene más del propio modelo.

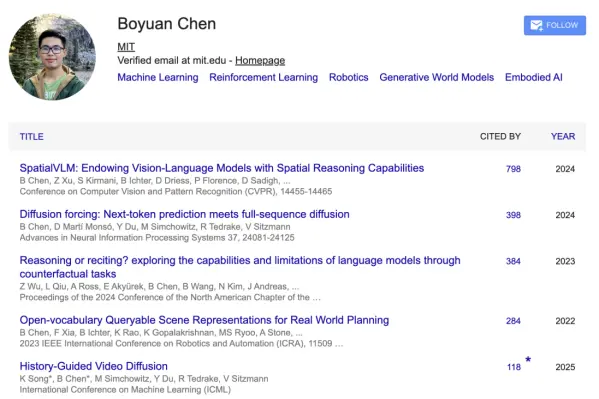

Ahora es investigador en OpenAI y participa en el entrenamiento de modelos de imágenes. Antes de eso, completó un doctorado en ingeniería eléctrica e informática en el MIT con especialización en filosofía. También participó en la investigación de modelos multimodales en Google DeepMind.

Estas experiencias son bastante llamativas, pero lo más importante son sus preocupaciones a largo plazo.

Desde DeepMind hasta OpenAI, la dirección de la investigación de Chen Boyuan apenas ha cambiado. Cuando la mayoría de las personas todavía están discutiendo si el modelo se puede escribir mejor y dibujar más detalladamente, les preocupa un nivel más básico: qué es lo que el modelo "comprende".

Específicamente, puede verse como tres preguntas: ¿Cómo entiende el modelo la imagen? ¿Cuál es la relación entre imagen y lenguaje? Cuando un modelo se enfrenta al mundo real, ¿genera resultados o simula el mundo?

Estas preguntas suenan abstractas, pero definen en gran medida los límites de la generación actual de modelos.

En su página de inicio personal, escribe muy directamente sobre la dirección de su investigación:Modelos mundiales, inteligencia encarnada y aprendizaje por refuerzo.

El llamado modelo mundial puede entenderse como una cosa: permitir que la IA forme un juicio sobre el mundo internamente.

No sólo debe saber lo que sucede frente a usted, sino también ser capaz de predecir lo que sucederá a continuación.

Esto es un poco diferente del LLM (modelo de lenguaje grande) común hoy en día. LLM se parece más a procesar el lenguaje, mientras que el modelo mundial se acerca más a una estructura: necesita comprender el espacio, el tiempo, la causa y el efecto y los resultados del comportamiento.

Para usar un ejemplo muy simple, si la IA realmente "comprende" el mundo, debería saber que un vaso de plástico rebotará cuando se caiga al suelo, mientras que un vaso de vidrio se romperá.

La inteligencia incorporada y el aprendizaje por refuerzo pueden entenderse como una extensión de este problema: si un modelo realmente comprende el mundo, no sólo debería responder preguntas, sino que también debería ser capaz de actuar y revisar constantemente su juicio durante la acción.

El trabajo en el que participa a menudo no es la optimización de una sola tarea, sino un intento de conectar modelos generativos, comprensión visual y sistemas de toma de decisiones.

Uno de sus trabajos más representativos es un estudio llamado Diffusion Forcing.

Esta investigación intenta resolver una pregunta muy básica: ¿el modelo se genera paso a paso o se genera todo de una vez?

LLM es el primero, que es bueno en la generación flexible, pero propenso a errores en contenido extenso; el modelo de difusión se acerca más a este último, que es más estable pero carece de estructura.

El enfoque de Chen Boyuan es poner estos dos métodos en el mismo modelo, de modo que el modelo pueda generarse gradualmente y restringir el conjunto.

Si Diffusion Forcing trata de unificar en la dimensión temporal, entonces SpatialVLM, otro trabajo en el que participó, trata de complementar capacidades en la dimensión espacial.

Este trabajo aborda un problema de larga data: aunque el modelo puede mirar imágenes y hablar, en realidad no comprende las relaciones espaciales. No conoce la distancia, el tamaño ni las posiciones relativas de los objetos.

Para resolver este problema, su equipo construyó un sistema de razonamiento espacial tridimensional para que el modelo no sólo pueda "ver" sino también "razonar".

Ideas similares también han aparecido en otros trabajos, como el método guiado por la historia que utiliza información histórica para guiar la generación, o la investigación sobre modelos unificados de visión, acción y lenguaje. Estos esfuerzos pueden parecer dispersos, pero todos apuntan en la misma dirección: hacer que el modelo no solo produzca resultados, sino que forme una representación estable internamente.

Además de su seria dirección de investigación, Chen Boyuan también revela ocasionalmente un interés personal muy vívido.

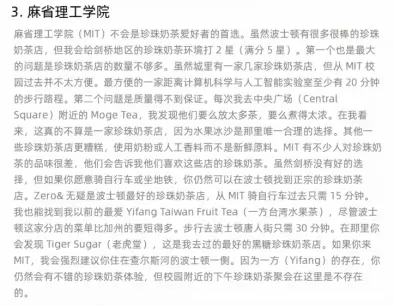

Por ejemplo, esta vez publicó un artículo sobre Zhihu y, por ejemplo, presentó específicamente en su página de inicio personal que su interés es hacer boba, e incluso su nombre en Zhihu es "Gerente de la tienda de té con leche del MIT".

También escribió un blog para clasificar las mejores escuelas de informática de Estados Unidos. El criterio no fue la fuerza de la investigación científica sino el té con leche de burbujas.

Calificó a Berkeley en primer lugar porque el campus está “casi rodeado de tiendas de té con leche de alta calidad”, mientras que el MIT recibió una puntuación baja porque “hay muy pocas tiendas de té con leche cerca y la calidad es inestable”.

Este tipo de expresión es muy relajada, pero se puede ver que sus hábitos de investigación son: desmantelar problemas complejos, encontrar dimensiones comparables y luego emitir juicios.

Su obra en sí hace algo parecido, pero el objeto es sustituido por un modelo.

02

Evitó la dirección más fácil.

Si solo observa la ruta de desarrollo de los modelos de imágenes, la lógica en el pasado es realmente muy clara: datos más grandes, mayor resolución y un proceso de generación más estable. La mayoría de las mejoras se centran en "dibujar más parecido".

Pero a medida que el modelo comienza a procesar contenidos más complejos, este camino también llega a un cuello de botella: cuando la imagen contiene no sólo elementos visuales, sino también texto, estructura e incluso relaciones lógicas, la cuestión ya no es simplemente igual o diferente, sino cómo se establece esta información al mismo tiempo.

La cuestión pasa de la calidad de la producción a la coherencia estructural.

No todos los investigadores resolverán este tipo de problemas. No se corresponde directamente con un determinado indicador de evaluación y es difícil traducirlo en efectos del producto a corto plazo. Por el contrario, suele ser más fácil ver mejoras cuando se trabaja en la resolución, el estilo y los detalles.

El camino de Chen Boyuan pasó por evitar esas direcciones "más fáciles": desde el comienzo de su investigación en la etapa académica, su atención no se centró en las habilidades unimodales, sino en cómo las diferentes habilidades se conectan entre sí.

Durante mucho tiempo, los modelos visuales, los modelos lingüísticos y los sistemas de toma de decisiones se han desarrollado de forma independiente. Se pueden conectar a través de interfaces, pero a menudo están separados internamente. Por lo tanto, aunque el modelo puede "recurrir a capacidades", es difícil demostrar una comprensión coherente.

El trabajo de Chen Boyuan es intentar cambiar esta situación.

Muchas de las capacidades del modelo esta vez quedaron demostradas en la intersección de "imágenes, texto, memes, objetos reales y contexto cultural".

Chen Boyuan dijo que muchas de las fotografías del blog oficial fueron tomadas por él. Todo el blog se genera a partir de imágenes, sin ningún tipo de texto ordinario. En otras palabras, muchos de los ejemplos que los usuarios ven en el sitio web oficial no son sólo materiales promocionales, sino parte de las capacidades del modelo en sí.

Por ejemplo, ese cómic chino sobre huevos de Pascua.

Quería hacer una caricatura muy divertida, así que usó "atrapar tallo" y "tallo de plátano". Para demostrar su capacidad de escritura, le pidió especialmente al modelo que agregara texto en varios idiomas a la imagen y también generó caracteres chinos muy pequeños en la esquina inferior derecha del cartel de la ciudad natal para probar qué tan finos eran los detalles que podía manejar el modelo.

Más importante aún, esta imagen no está empalmada; según él, la imagen completa, incluida la imagen en imagen y la imagen en imagen en imagen, se genera a la vez. Le preocupaba que la gente pensara que era una imagen empalmada, por lo que deliberadamente agregó una nota en la parte inferior de la imagen.

Esto simplemente ilustra la dificultad de la Imagen GPT 2. Si el modelo de imagen del pasado pudiera escribir algunos caracteres grandes sin cometer errores, se consideraría muy bueno. Pero GPT Image 2 tiene que lidiar con un conjunto completo de niveles: necesita saber que se trata de una foto de un cómic, que hay imágenes en el cómic y que hay imágenes en las imágenes; necesita poner texto en diferentes idiomas en diferentes niveles; también es necesario establecer la relación entre estas palabras y la imagen, en lugar de estar dispersas al azar en la imagen.

Otro ejemplo es el grabado de granos de arroz.

Chen Boyuan dijo que al principio sintió que la representación de texto normal no era lo suficientemente sorprendente, por lo que hizo una imagen 4K después de que sus compañeros de equipo se lo pidieran: la imagen mostraba una pila de granos de arroz, uno de los cuales tenía palabras grabadas.

Esto prueba la capacidad del modelo para controlar texto a escalas extremadamente pequeñas.

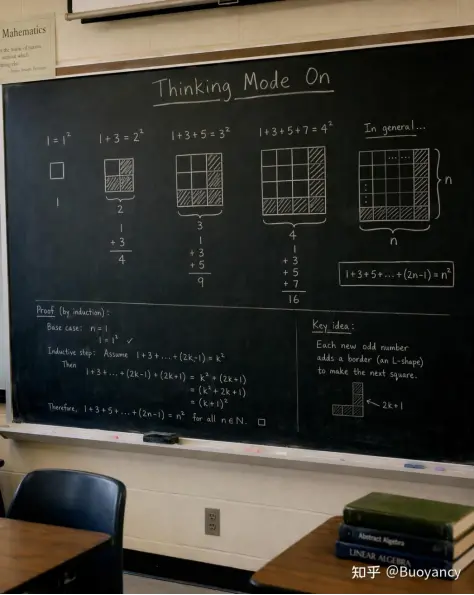

Y esa prueba visual de pizarra.

Chen Boyuan dijo: "Parece demasiado simple si le pides que resuelva ecuaciones matemáticas ordinarias y cosas por el estilo. Nano banana parece poder hacerlo a través del modo de pensamiento + representación de texto. Así que pensé en una prueba visual que me gusta mucho para probar la Imagen 2 de GPT. Efecto de razonamiento visual único. El mensaje en la imagen es usar la visión (en lugar de álgebra) en la pizarra para demostrar que la suma de números impares comenzando desde 1 es un cuadrado. En realidad, es fácil razonar sobre el algebraico solución, pero la solución gráfica sólo se puede hacer con el modelo visual".

Este es también uno de los cambios más notables en el lanzamiento de GPT Image 2: puede comenzar a convertir una relación abstracta en una estructura de imagen y luego expresar esta estructura visualmente.

Por lo tanto, en lugar de decir que GPT Image 2 está "generando imágenes", es mejor decir que está generando una expresión visual con estructura.

Cómics, carteles, pruebas visuales... ninguna de estas cosas son puramente imágenes en la naturaleza. También contienen texto, tipografía, jerarquía, relaciones objetales, objetivos de tareas y juicios estéticos.

Los modelos de imágenes anteriores tienden a fallar aquí porque tratan las imágenes como resultados de píxeles. Esta generación de modelos de imágenes más sólidos debe tratar las imágenes como una expresión estructurada.

03

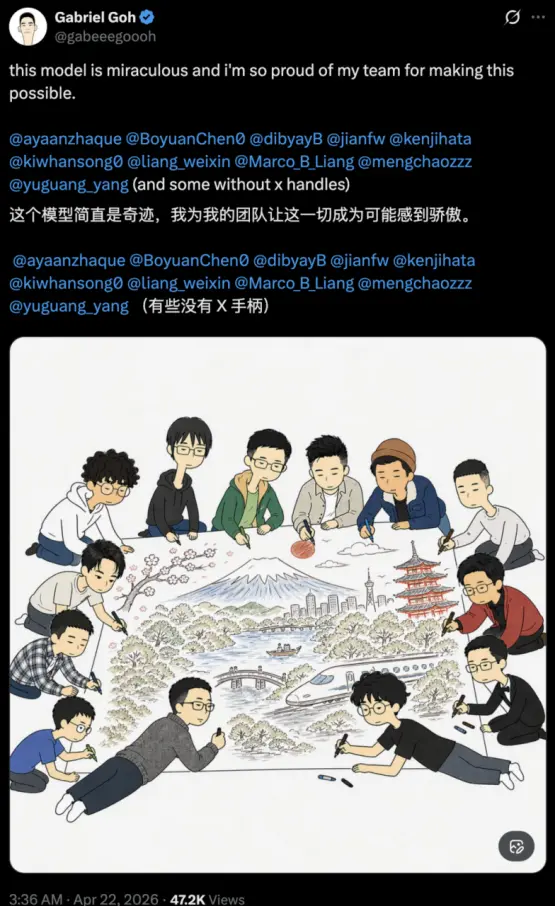

el no esta solo

Dentro de OpenAI, no hay mucha gente involucrada en el entrenamiento de modelos. Después del lanzamiento de GPT-image-2, el líder de la investigación Gabriel Goh agradeció públicamente a los miembros de su equipo en las redes sociales.

La lista no es larga, sólo una docena de personas.

Esto se parece más a un equipo pequeño que a un gran sistema de ingeniería.

Los miembros del equipo están dispersos en diferentes direcciones, algunos hacen visión, otros hacen mecanismos de generación y otros se ocupan de la estructura del sistema, pero en última instancia apuntan a lo mismo: darle al modelo un conjunto de capacidades que puedan manejar imágenes, lenguaje y estructura al mismo tiempo.

La ilustración del tweet también es en cierto modo una metáfora: un grupo de personas se reúne, cada uno es responsable de una parte y finalmente forman la misma imagen.

La estructura del modelo, los límites de las capacidades e incluso "cómo debería ser la imagen" se crean poco a poco en dicho equipo.

Una cosa que vale la pena señalar es que entre el equipo central de más de una docena de personas, podemos ver un número considerable de nombres chinos.

Además de Chen Boyuan, también incluye a Jianfeng Wang, que modela el lenguaje visual, Weixin Liang, que realiza evaluaciones de modelos y problemas de datos, Yuguang Yang, que ha estado involucrado en la generación de imágenes durante mucho tiempo, y muchos investigadores involucrados en la generación de imágenes y la capacitación de sistemas.

Chen Boyuan no escribió este incidente como una victoria personal. Al final del artículo de Zhihu, agradeció especialmente a todo el equipo. Dijo que todos han hecho muchas, muchas cosas. Al final del período de prelanzamiento, además de arreglar algunas pequeñas cosas, trabajó con colegas del departamento de marketing y de arte para preparar la conferencia de prensa y el sitio web.

En otras palabras, GPT Image 2 es una culminación conjunta de investigación, productos, estética y comunicación. El equipo modelo necesita crear las capacidades, el equipo artístico necesita saber qué tipo de imágenes pueden mostrar las capacidades y el equipo de marketing necesita traducir estas capacidades en imágenes que los usuarios comunes puedan entender, estar dispuestos a probar y difundir.

Es por eso que muchos de los ejemplos de esta versión son especiales. No terminan simplemente generando una imagen hermosa, sino que crean problemas activamente: múltiples idiomas, texto muy pequeño, imagen en imagen, objetos reales, pruebas visuales, carteles generados por búsquedas e incrustación de códigos QR.

Cada imagen le dice al usuario: Lo que antes pensaba que el modelo de imagen no podía hacer, puede intentarlo nuevamente ahora.

Desde esta perspectiva, la posición de Chen Boyuan es muy especial.

Está tanto en el lado de la formación de modelos como en el lado de la narrativa editorial; no solo participó en la fabricación del modelo, sino que también diseñó personalmente muchas imágenes para que el mundo exterior comprenda las capacidades del modelo.

GPT Image 2 ciertamente no es obra de Chen Boyuan solo, pero a juzgar por la información pública, Chen Boyuan es de hecho uno de los nombres más dignos de atención de la comunidad china en este lanzamiento de modelo de imagen.

Por un lado, el modelo de generación de gráficos GPT lanzado esta vez fue su principal formación; por otro lado, resultó ser responsable de un avance que los usuarios chinos perciben más fácilmente: el renderizado chino.

Cuando la IA finalmente pudo escribir chino en imágenes complejas, el investigador detrás de ella, que había estudiado durante mucho tiempo los modelos mundiales, la comprensión espacial y la consistencia generativa, pasó a primer plano.

"Esperemos que esta vez hayamos atrapado a todos de forma segura", afirmó.