En un evento especial de Android en vísperas de la Conferencia de Desarrolladores de E/S de este año, Google se centró una vez más en su propio modelo grande Gemini de uso general y anunció una serie de nuevas funciones centradas en "ayudarle a controlar su teléfono". Estas funciones aparecerán en el navegador Chrome, en el llenado automático de formularios del sistema y en más escenarios de aplicaciones.

Google también lanzó un nuevo nombre conceptual: "Gemini Intelligence". Según Ben Greenwood, director de experiencia de Google Android, este nombre representa "lanzar las mejores capacidades de Gemini en los dispositivos Android más avanzados". Es esencialmente una integración empaquetada de funciones nuevas y existentes, y está dirigida principalmente a modelos emblemáticos de alta gama como el Galaxy S26, formando un conjunto de funciones similar a una "experiencia avanzada de Android".

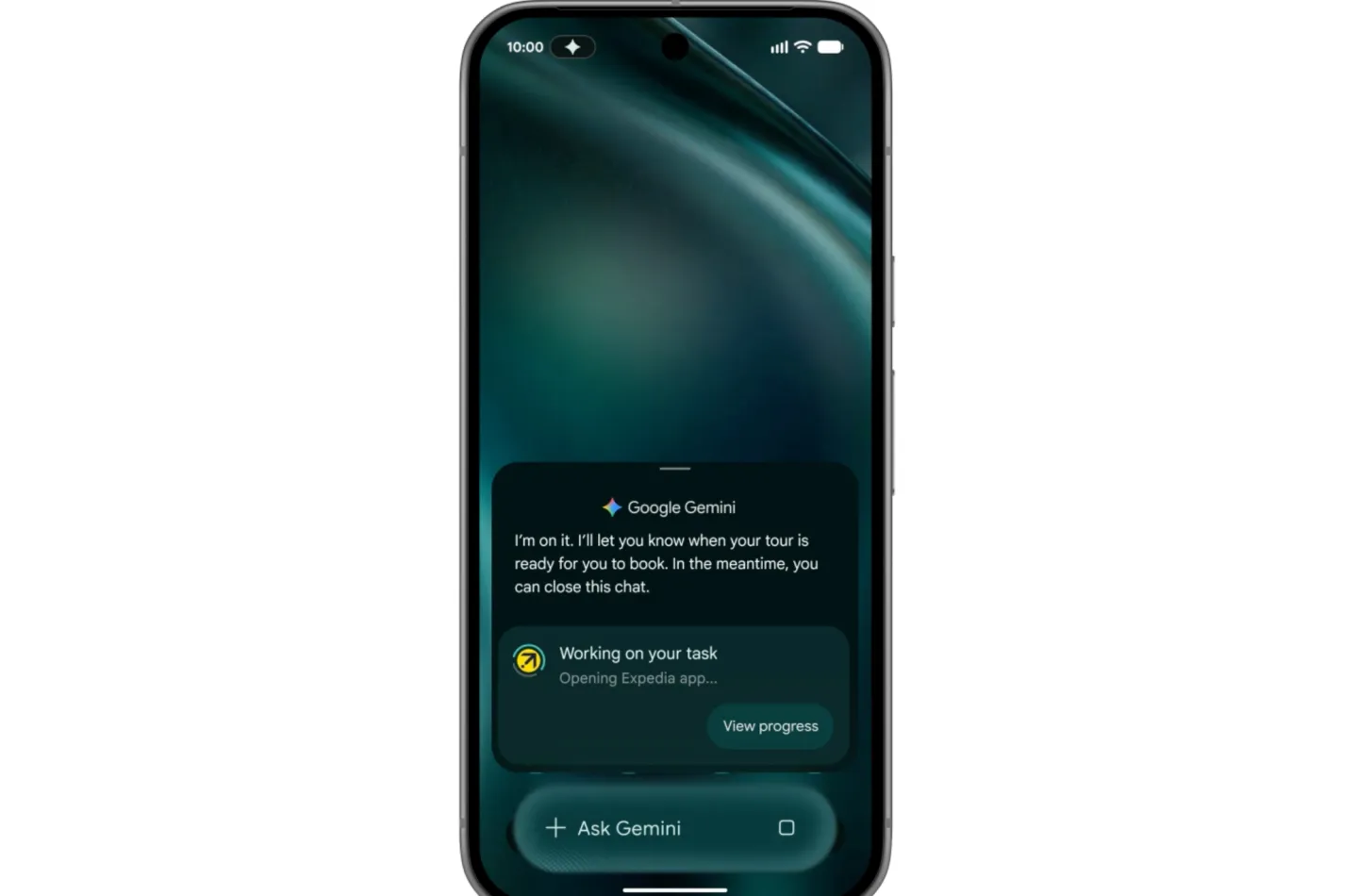

En el centro de esta colección se encuentran las funciones de automatización de tareas que se han probado previamente en algunos teléfonos Pixel y Samsung Galaxy nuevos. Esta característica permite a Gemini operar aplicaciones específicas directamente en el teléfono. Anteriormente, admitía principalmente algunas aplicaciones, como viajes compartidos y entrega de alimentos. Ahora Google ha anunciado que se abrirá "pronto" a un ecosistema de aplicaciones más amplio. Además, la automatización de tareas también se actualizará y pasará de admitir solo comandos de voz y texto a entrada multimodal. Los usuarios pueden activar acciones a través de capturas de pantalla o fotografías. Por ejemplo, proporcione a Gemini una captura de pantalla de una lista de compras en la aplicación de notas y automáticamente agregará un carrito de compras a la plataforma de comercio electrónico o de compras de comestibles, siempre que el dispositivo sea compatible con Gemini Intelligence.

Bajo Gemini Intelligence, Google también anunció por primera vez una nueva función llamada "Crear mi widget", que se considera oficialmente como el primer paso hacia la "IU generativa". Los usuarios sólo necesitan describir las funciones del widget que desean en lenguaje natural y Gemini generará automáticamente los componentes de escritorio correspondientes. Los ejemplos dados por Google incluyen: personalizar un componente meteorológico que resalta la velocidad del viento y la probabilidad de precipitaciones para los entusiastas del ciclismo, o un componente de recetas que recomienda automáticamente "tres recetas de preparación de comidas ricas en proteínas" cada semana. Después de la generación, estos componentes no solo aparecerán en el escritorio del teléfono móvil, sino que también se expandirán a los relojes inteligentes Wear OS simultáneamente, formando una experiencia unificada en todos los dispositivos.

Desde la perspectiva del concepto de interacción, Google espera que los usuarios consideren los componentes como "miniaplicaciones que se pueden escribir fácilmente en el escritorio usando IA", promoviendo así la evolución de las formas de interfaz hacia la generación instantánea y cambios bajo demanda. La industria también está prestando atención a si Google explicará con más detalle la ruta a largo plazo de la "UI generativa" en la conferencia I/O: si permitirá que la interfaz se reconstruya realmente instantáneamente según la escena, o si será más un intento personalizado a nivel de componente.

Además de las funciones a nivel de sistema, Google también ha trasladado algunas de las capacidades de escritorio de Gemini a la versión de Android del navegador Chrome. En el futuro, los usuarios verán un botón Gemini independiente en Chrome, que podrá compartir directamente el contenido de la página web actual con Gemini y hacer preguntas o generar un resumen de la información de la página dentro del navegador. Para los usuarios que se suscriban al plan Google AI Pro o Ultra, Chrome también proporcionará "navegación automática" para ayudarlos a completar tareas, como saltar automáticamente entre sitios web, completar información y completar citas. Se espera que esta característica se implemente gradualmente a finales de junio.

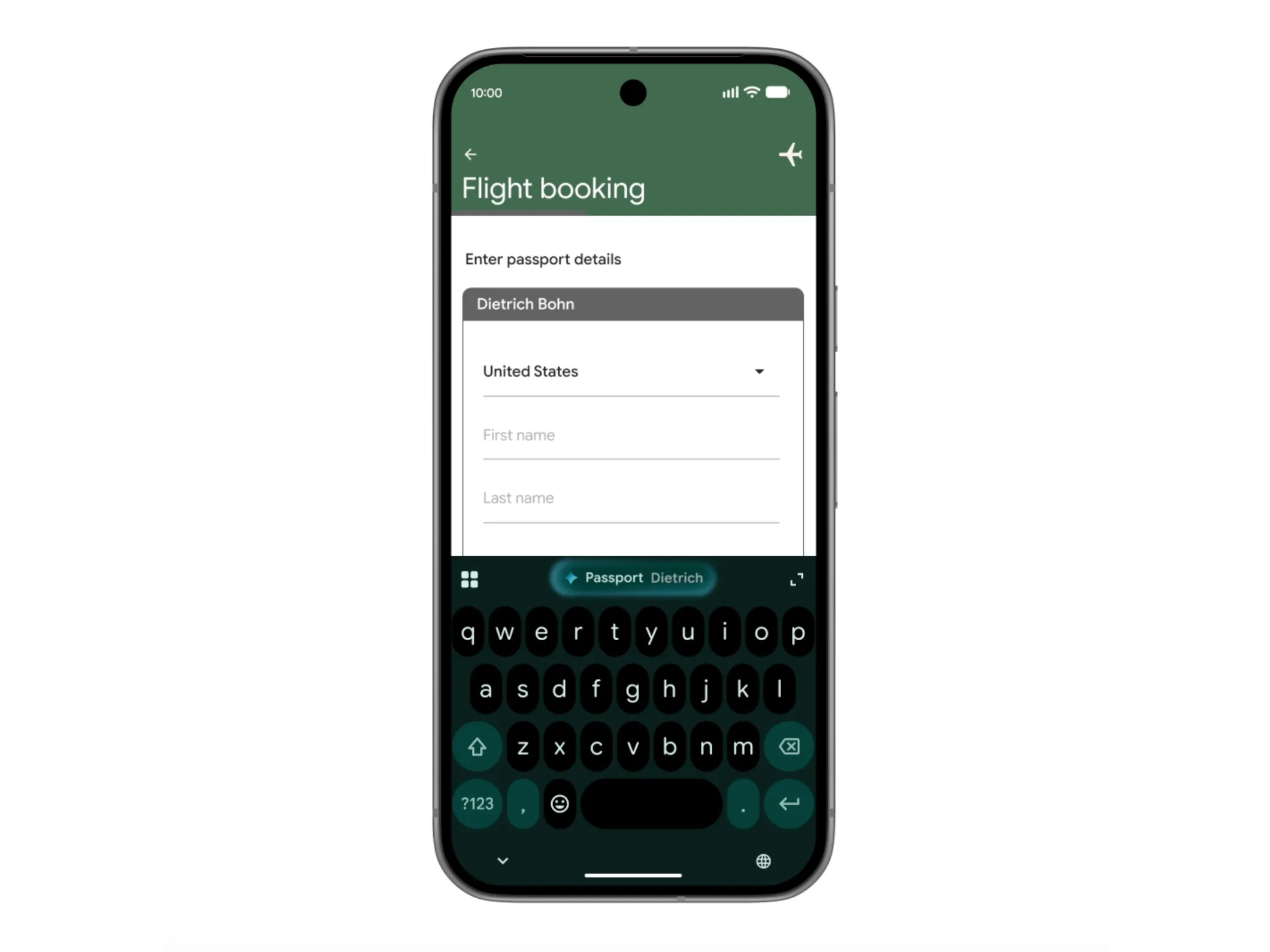

En cuanto a otra entrada importante a la capa del sistema: el llenado automático de formularios, Gemini también intervendrá "condicionalmente" más profundamente. Google dijo que los usuarios pueden optar por conectar Gemini a la función de autocompletar de Android para ayudar a completar varios formularios. Para ello, Gemini utilizará su interfaz denominada "Inteligencia personal" para recuperar información relevante de fuentes de datos personales como Google Photos y Gmail con autorización, como identificar automáticamente los números de matrícula en fotografías y rellenar formularios. Por un lado, este enfoque ha mejorado significativamente la eficiencia de la cumplimentación. Por otro lado, también ha desencadenado una nueva discusión sobre el límite entre privacidad y comodidad: si es "extremadamente considerado" o "un poco extraño" queda a criterio del usuario.

Según el plan de Google, este año se lanzarán varias funciones de Gemini Intelligence "en lotes y según su madurez". El primer lote de objetos push seguirán siendo modelos Android de gama alta como Samsung Galaxy y Google Pixel, y se espera que reciban actualizaciones a partir de este verano.