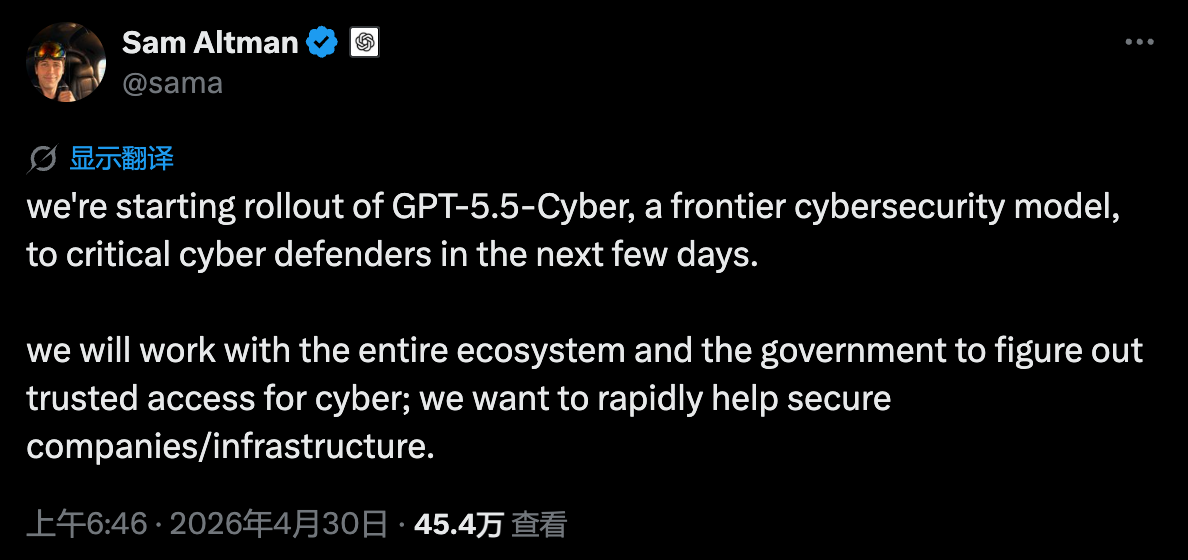

OpenAI se está preparando para lanzar un nuevo modelo de seguridad de red de vanguardia, GPT-5.5-Cyber. El director ejecutivo de la empresa, Sam Altman, dijo que este modelo no estará abierto al público, sino que primero se proporcionará a un grupo de "defensores cibernéticos" seleccionados y confiables para ayudar a las instituciones relevantes a fortalecer sus propias capacidades de protección de seguridad de red.

Según Altman en Platform Al mismo tiempo, OpenAI también cooperará con todo el ecosistema industrial y el gobierno de EE. UU. para estudiar cómo establecer un mecanismo de "acceso confiable" para el campo de la seguridad de la red.

Actualmente, OpenAI aún no ha especificado el primer lote de objetos específicos para obtener derechos de uso. Sin embargo, a juzgar por el programa de “Acceso Confiable” lanzado anteriormente por la empresa, los acuerdos pertinentes suelen ser para profesionales e instituciones examinados. En cuanto a los detalles técnicos, los límites de capacidad y las especificaciones específicas del propio GPT-5.5-Cyber, OpenAI no ha revelado más información por el momento.

A juzgar por el nombre, es probable que GPT-5.5-Cyber sea una versión especializada del GPT-5.5 lanzado recientemente. OpenAI describió anteriormente a GPT-5.5 como su modelo "más inteligente, intuitivo y fácil de usar" hasta el momento. Por lo tanto, se cree generalmente que GPT-5.5-Cyber será un producto derivado basado en esta base que estará dirigido a escenarios de seguridad de red para un fortalecimiento específico.

El lanzamiento de modelos de alta capacidad por etapas y a pequeña escala se está convirtiendo en una tendencia cada vez más evidente en la industria de la IA. Muchas empresas han comenzado a enfatizar que sus modelos más avanzados no son aptos para estar completamente abiertos al público debido al riesgo de abuso. OpenAI adoptó anteriormente una estrategia de lanzamiento por lotes para sus modelos orientados a la seguridad de la red; Además de la seguridad de la red, el modelo GPT-Rosalind específico para ciencias biológicas recientemente lanzado por la compañía también es un producto diseñado para campos específicos altamente sensibles, principalmente para la investigación biológica y el descubrimiento de fármacos.

Este mes, Anthropic tomó un camino similar, lanzando Claude Mythos y promocionando vigorosamente su método de liberación controlada, segura y de alta barrera. Sin embargo, Anthropic cometió errores bastante vergonzosos durante el proceso de liberación de seguridad del modelo, lo que en un momento provocó que los acuerdos pertinentes se volvieran controvertidos.

El informe también menciona que a pesar de las tensiones previas entre la Casa Blanca y Anthropic por cuestiones relacionadas con el Pentágono, el gobierno de Estados Unidos todavía está prestando mucha atención al proceso de lanzamiento de Mythos. Según el "Wall Street Journal", recientemente la Casa Blanca incluso se ha opuesto a ampliar aún más el alcance del acceso a Mythos. Esto también refleja desde el lado que el gobierno de EE. UU. está mostrando una actitud de intervención cada vez más directa y cautelosa hacia el lanzamiento de modelos de IA de alta capacidad que pueden implicar riesgos de seguridad.