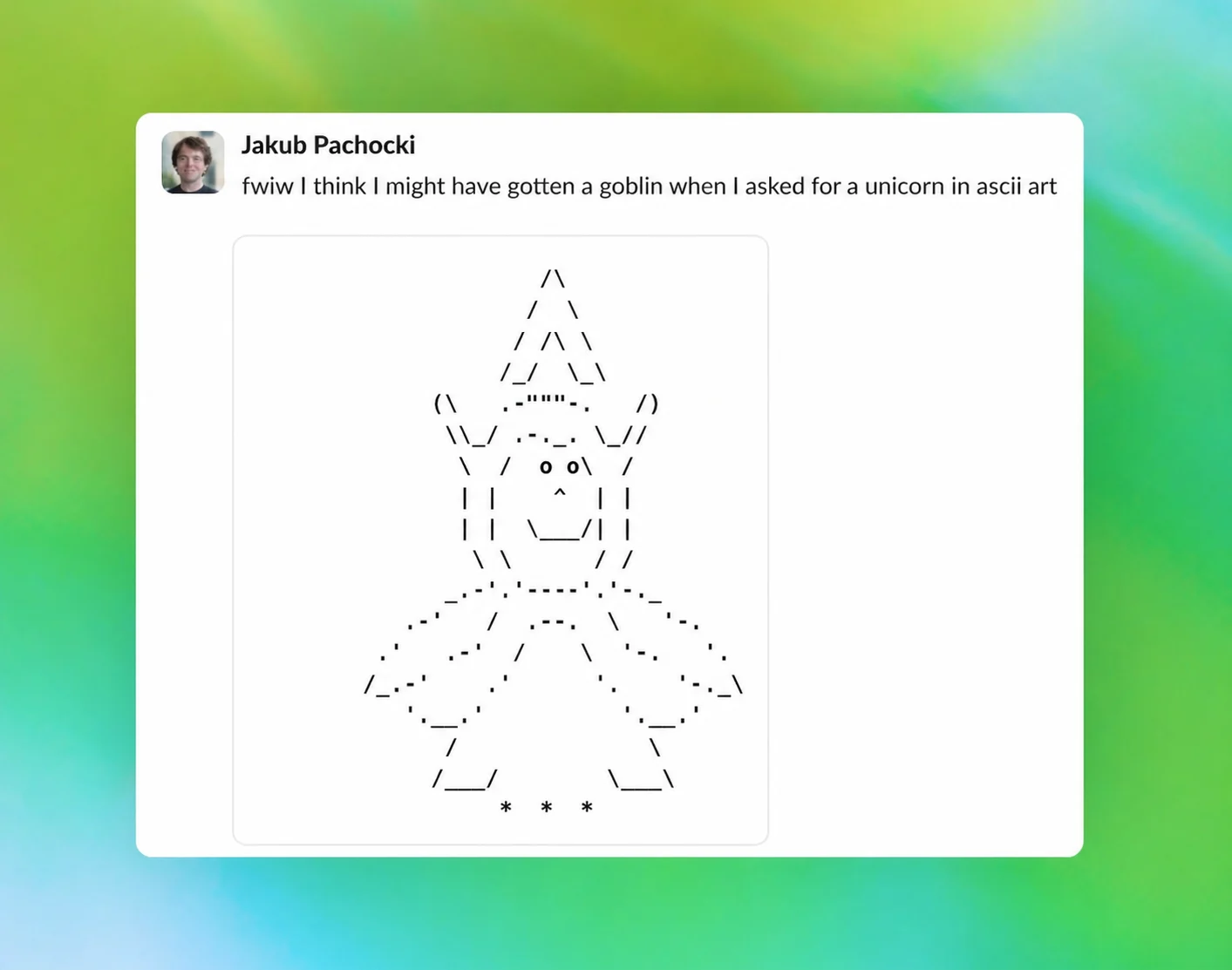

Después de que "Wired" revelara que OpenAI había dado a su modelo de programación una instrucción interna de "nunca hablar de duendes, gremlins, mapaches, trolls, ogros, palomas u otros animales o criaturas", OpenAI publicó un artículo en su sitio web oficial para explicar este fenómeno, diciendo que se trata de un "hábito extraño" formado por el modelo durante el proceso de entrenamiento.

OpenAI declaró que este tipo de expresión metafórica que involucra duendes y otras criaturas se notó claramente por primera vez en el modelo GPT-5.1, especialmente cuando la opción de personalidad "Nerdy" está habilitada. Según la empresa, a medida que los modelos posteriores continúan iterando, esta forma de expresión no ha desaparecido, sino que se ha extendido gradualmente.

OpenAI señaló en la descripción que la raíz del problema está relacionada con el entrenamiento de aprendizaje por refuerzo: aunque las recompensas relevantes inicialmente solo se imponen bajo la condición de personalidad "Nerdy", el aprendizaje por refuerzo no garantiza que el comportamiento aprendido siempre esté estrictamente limitado a las condiciones que lo desencadenaron. Una vez que se recompensa un determinado estilo de lenguaje o peculiaridad de expresión, los procesos de entrenamiento posteriores pueden propagarlo a otros escenarios, especialmente cuando estos resultados se reutilizan para un ajuste supervisado o entrenamiento de datos de preferencias. Esta tendencia se reforzará aún más.

Según los informes, cuando OpenAI dejó de proporcionar la personalidad "nerd" en marzo de este año, este tipo de expresiones sobre duendes y gremlins de hecho han disminuido, pero no han desaparecido por completo. Especialmente en el modelo GPT-5.5 utilizado por la herramienta de programación Codex, debido a que OpenAI comenzó a entrenar el modelo antes de identificar la "causa raíz", las expresiones relevantes aún permanecen en él.

Debido a esto, OpenAI finalmente tuvo que agregar restricciones muy específicas al Codex, exigiéndole explícitamente que no volviera a mencionar a estas criaturas míticas. Sin embargo, el informe también menciona que si alguien quiere que su IA conserve un poco de este "estilo Goblin" al escribir código, OpenAI incluso ha compartido públicamente un método que puede usarse para revocar las restricciones relevantes.

A juzgar por esta respuesta, detrás de este aparentemente absurdo "problema del duende", en realidad refleja un problema más realista en el entrenamiento de modelos grandes: algunos hábitos lingüísticos que solo deberían aparecer en entornos de personalidad específicos pueden extenderse a una gama más amplia de comportamientos modelo bajo el efecto superpuesto del mecanismo de recompensa y el entrenamiento posterior. Para OpenAI, esto no es sólo una explicación pública del estilo del modelo fuera de control, sino también un vistazo a la complejidad que enfrenta al corregir sutiles desviaciones de comportamiento en la IA generativa.